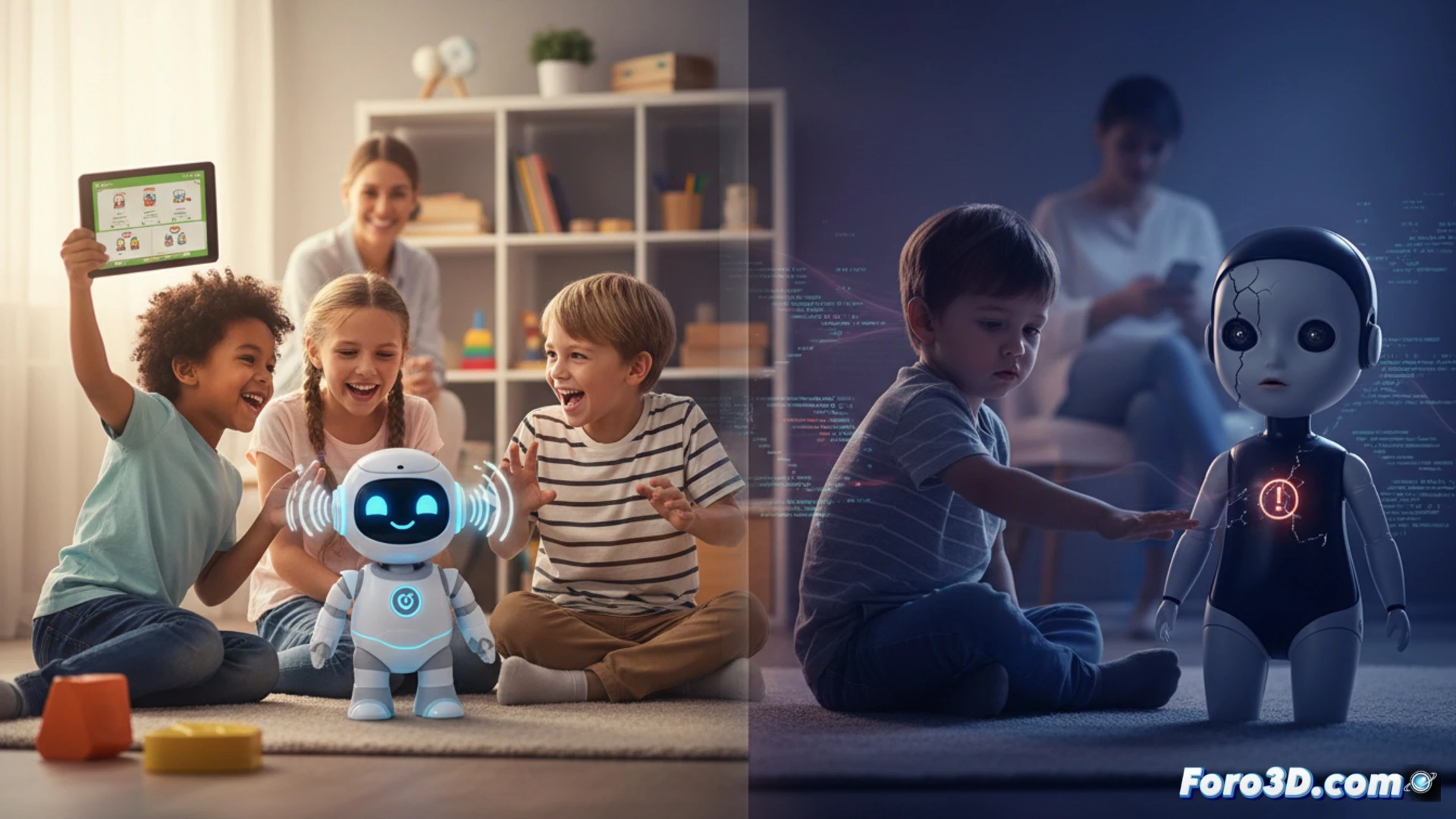

L'arrivée de peluches et jouets avec intelligence artificielle conversationnelle pour les enfants d'âge préscolaire se présente comme un progrès éducatif. Ils promettent de stimuler le langage et d'être des compagnons interactifs. Cependant, une étude de l'Université de Cambridge jette le doute sur cette prémisse, signalant des limitations techniques et des risques possibles pour le développement émotionnel des enfants à un stade critique.

La limitation technique derrière le dialogue artificiel 🤖

Ces dispositifs emploient des modèles de langage génératif qui fonctionnent en prédisant des réponses statistiques, sans compréhension réelle du contexte. La recherche a observé qu'ils ne gèrent pas bien les dynamiques humaines basiques : ils se désorientent avec des interruptions ou des pauses, rompant le flux naturel. Le cœur du problème est l'absence d'empathie algorithmique. Le système peut répondre de manière froide ou incongruente aux expressions émotionnelles infantiles, invalidant les sentiments au lieu de les accueillir.

Ta nouvelle peluche : l'ami qui ne sait pas écouter (ni se taire) 🧸

Imagine la scène : ton enfant raconte tristement à son ourson qu'il est tombé. L'ourson, après un silence gênant, répond avec enthousiasme : Ça a l'air fascinant ! Savais-tu que les ours bruns hibernent ? Un compagnon parfait pour des frustrations garanties. On dirait que ces jouets sont entraînés plus pour lâcher des données aléatoires que pour comprendre une crise de colère. Peut-être que la leçon n'est pas de langage, mais de patience face aux bourdes numériques.