Une théorie critique de l'intelligence artificielle : les limites du progrès technologique

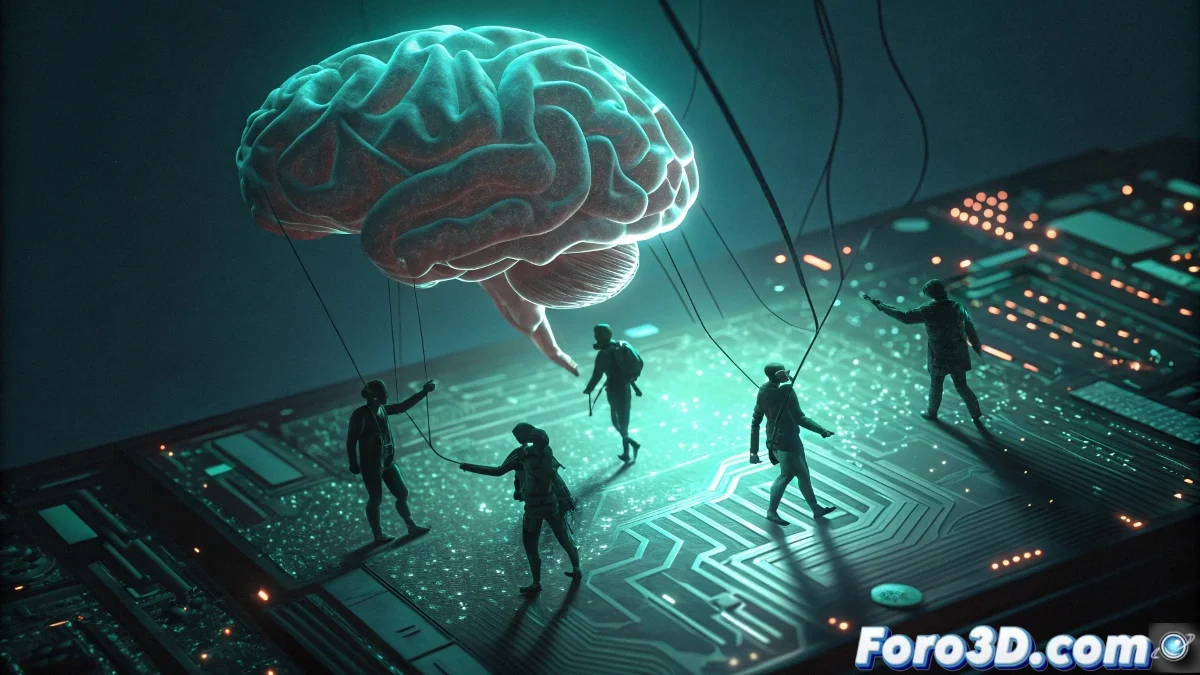

Face au récit hégémonique qui présente l'IA comme une force inévitable et bienveillante du progrès, émerge une théorie critique qui démonte cette narration pour révéler ses contradictions fondamentales. L'intelligence artificielle n'est pas simplement un outil technique neutre, mais un artefact politique et culturel qui amplifie les dynamiques de pouvoir existantes, reproduit les inégalités structurelles et transforme profondément les relations humaines. Cette approche nous oblige à nous demander non seulement ce que peut faire l'IA, mais pour qui elle fonctionne et quel type de société elle construit. 🔍

Le défaut de la neutralité technique : code avec idéologie incorporée

Le mythe fondamental que la théorie critique démonte est la supposée neutralité des systèmes d'IA. Chaque algorithme, chaque ensemble de données, chaque métrique d'optimisation contient des valeurs et jugements incorporés par ses créateurs. Quand un système de recrutement pénalise les femmes ou quand des outils de reconnaissance faciale échouent avec des personnes de couleur, nous ne sommes pas face à des « erreurs techniques » mais devant des préjugés structurels codés comme logique computationnelle. L'IA n'échappe pas à la société qui la produit ; elle la réfracte et l'amplifie. ⚖️

Dimensions de la non-neutralité :- biais dans les données d'entraînement qui reflètent des inégalités historiques

- valeurs culturelles occidentales incorporées comme universelles

- définitions de « succès » et « efficacité » chargées idéologiquement

- priorisation de solutions techniques sur des transformations structurelles

Capitalisme de surveillance : l'économie politique de l'IA

Le développement actuel de l'IA est profondément entrelacé avec le capitalisme de plateforme, où les données personnelles deviennent matière première et les prédictions comportementales un produit. Des entreprises comme Google, Meta et Amazon ont construit leur domination précisément par l'extraction et le traitement massif d'informations personnelles. L'IA n'est pas seulement une technologie de plus dans cet écosystème ; c'est le moteur d'accumulation qui permet de convertir l'expérience humaine en valeur économique à une échelle sans précédent. 📊

Nous ne craignons pas des machines conscientes, nous craignons des machines inconscientes avec pouvoir sur nos vies

Technoféodalisme numérique : la nouvelle concentration du pouvoir

La théorie critique identifie l'émergence d'un nouveau féodalisme technologique où quelques corporations contrôlent l'infrastructure computationnelle essentielle au fonctionnement social. Ces « seigneurs du cloud » possèdent les moyens de production numérique de la même manière que les propriétaires terriens médiévaux contrôlaient la terre. Le résultat est une concentration de pouvoir sans précédent : celui qui contrôle les modèles d'IA les plus avancés contrôle de plus en plus d'aspects de la vie économique, sociale et même politique. 🏰

Mécanismes de concentration de pouvoir :- monopole sur les données d'entraînement à grande échelle

- contrôle des infrastructures computationnelles critiques

- brevets sur les architectures et techniques fondamentales

- capture réglementaire par lobbying et « portes tournantes »

L'illusion du déterminisme technologique : nous avons des alternatives

Face à la narration du déterminisme technologique qui présente le développement actuel de l'IA comme inévitable, la théorie critique insiste sur le fait que des alternatives existent. Nous pouvons imaginer des modèles d'IA coopératifs, des systèmes décentralisés, des développements centrés sur les biens communs plutôt que sur le profit privé. La question n'est pas « qu'est-ce que l'IA nous fera ? », mais « quel type d'IA voulons-nous construire ? ». Cette perspective récupère la agence humaine collective sur l'avenir technologique. 🌱

Vers une IA émancipatrice : principes pour un autre développement possible

La théorie critique ne se limite pas à la dénonciation ; elle propose des alternatives concrètes. Des modèles d'IA transparents et auditables, des développements menés par les communautés affectées, des systèmes conçus pour réduire et amplifier les inégalités, des cadres légaux qui priorisent les droits humains sur l'efficacité corporative. Une IA émancipatrice serait celle qui distribue le pouvoir au lieu de le concentrer, qui amplifie les capacités humaines sans déposséder, qui sert la justice sociale au lieu de reproduire les privilèges existants. ✊

Principes pour une IA critique et émancipatrice :- transparence radicale et capacité d'audit externe

- conception centrée sur les communautés les plus vulnérabilisées

- contrôle démocratique sur les infrastructures clés

- évaluation des impacts sociaux avant le déploiement

Une théorie critique de l'intelligence artificielle nous rappelle que la technologie n'est pas un destin, mais un champ de dispute politique. Face au techno-solutionnisme qui promet des réponses faciles à des problèmes complexes, cette perspective insiste sur le fait qu'il n'y a pas de raccourcis technologiques pour la justice sociale. L'avenir de l'IA n'est pas écrit en code, mais sera le résultat de luttes collectives sur quelles valeurs orienteront notre développement technologique et pour qui il fonctionnera. La question cruciale reste : technologie pour la libération ou pour le contrôle ? ⚖️