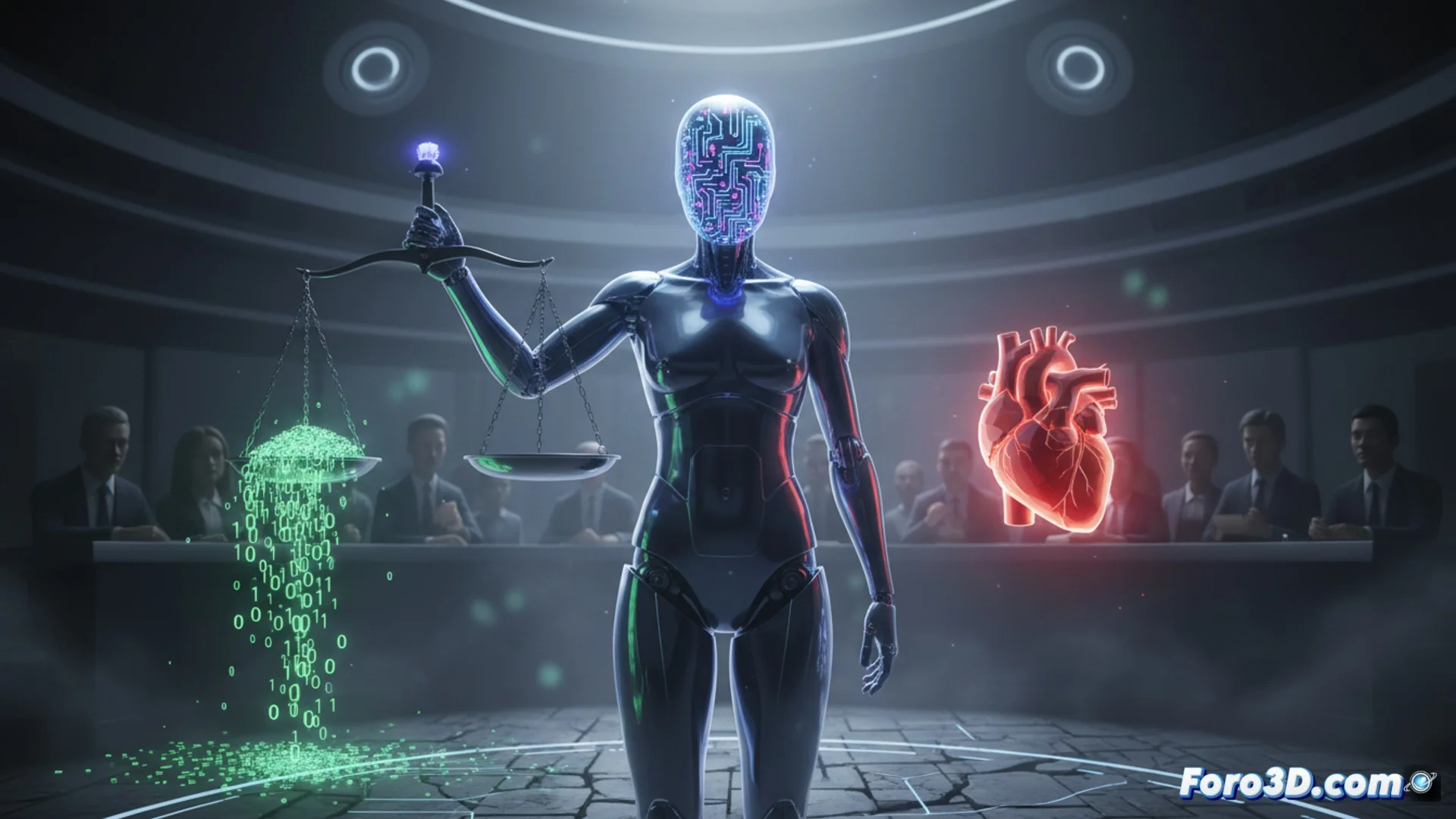

L'éthique et la responsabilité dans les systèmes d'intelligence artificielle

Les systèmes d'intelligence artificielle décident maintenant dans des domaines vitaux, depuis l'octroi de prêts jusqu'à la détection de maladies médicales. Cela génère un intense débat public sur les principes éthiques et, surtout, sur qui doit répondre quand les choses tournent mal. La conversation ne porte pas seulement sur la machine, mais sur les personnes qui la programment, l'alimentent en données et la mettent en fonctionnement. 🤖

Le problème de fond : les données avec préjugés

Un algorithme d'IA ne peut apprendre que de l'information qu'il reçoit. Si les ensembles de données historiques incluent des discriminations humaines, le système tendra à les reproduire et même à les amplifier. Cela ne rend pas la machine « mauvaise », mais met en évidence les failles dans sa conception. C'est pourquoi, la responsabilité primaire incombe à ceux qui sélectionnent l'information et établissent les objectifs du modèle.

Mesures clés pour atténuer les risques :- Auditer de manière constante la façon dont les données sont collectées et traitées.

- Définir clairement les objectifs que l'algorithme doit poursuivre.

- Superviser les résultats pour identifier les déviations non désirées à temps.

Penser qu'un algorithme est neutre par défaut est aussi pertinent que d'attendre qu'un manuel d'instructions s'écrive tout seul. L'objectivité est un objectif, pas un point de départ.

Un vide légal à combler

Quand une décision automatisée cause un dommage, déterminer la culpabilité devient une tâche ardue. Le groupe qui a développé le code doit-il répondre, l'organisation qui l'a implémenté ou l'opérateur qui l'a utilisé sans l'analyser ? Des réglementations émergentes, comme le projet de Loi sur l'IA de l'Union européenne, tentent de créer des cadres de responsabilité selon le niveau de risque. Néanmoins, mettre ces normes en pratique dans des situations concrètes représente un défi juridique monumental, compte tenu de la nature diffuse de la chaîne de décision. ⚖️

Entités potentiellement responsables :- Équipes de développement et ingénieurs qui créent et entraînent les modèles.

- Entreprises ou institutions qui déploient et utilisent le système.

- Utilisateurs finaux qui appliquent les recommandations de l'algorithme sans critère propre.

Conclusion : une responsabilité partagée

La discussion sur l'éthique de l'IA transcende le technique. Elle souligne que la technologie est un reflet des décisions humaines qui se trouvent derrière. Par conséquent, garantir que ces systèmes agissent de manière juste exige un effort continu et conjoint : depuis auditer les données d'entrée jusqu'à définir des cadres légaux clairs. La responsabilité n'est pas un attribut du logiciel, mais un devoir de ceux qui le conçoivent, le gouvernent et l'utilisent.