Et si les puces pour l'intelligence artificielle cessaient de coûter si cher ?

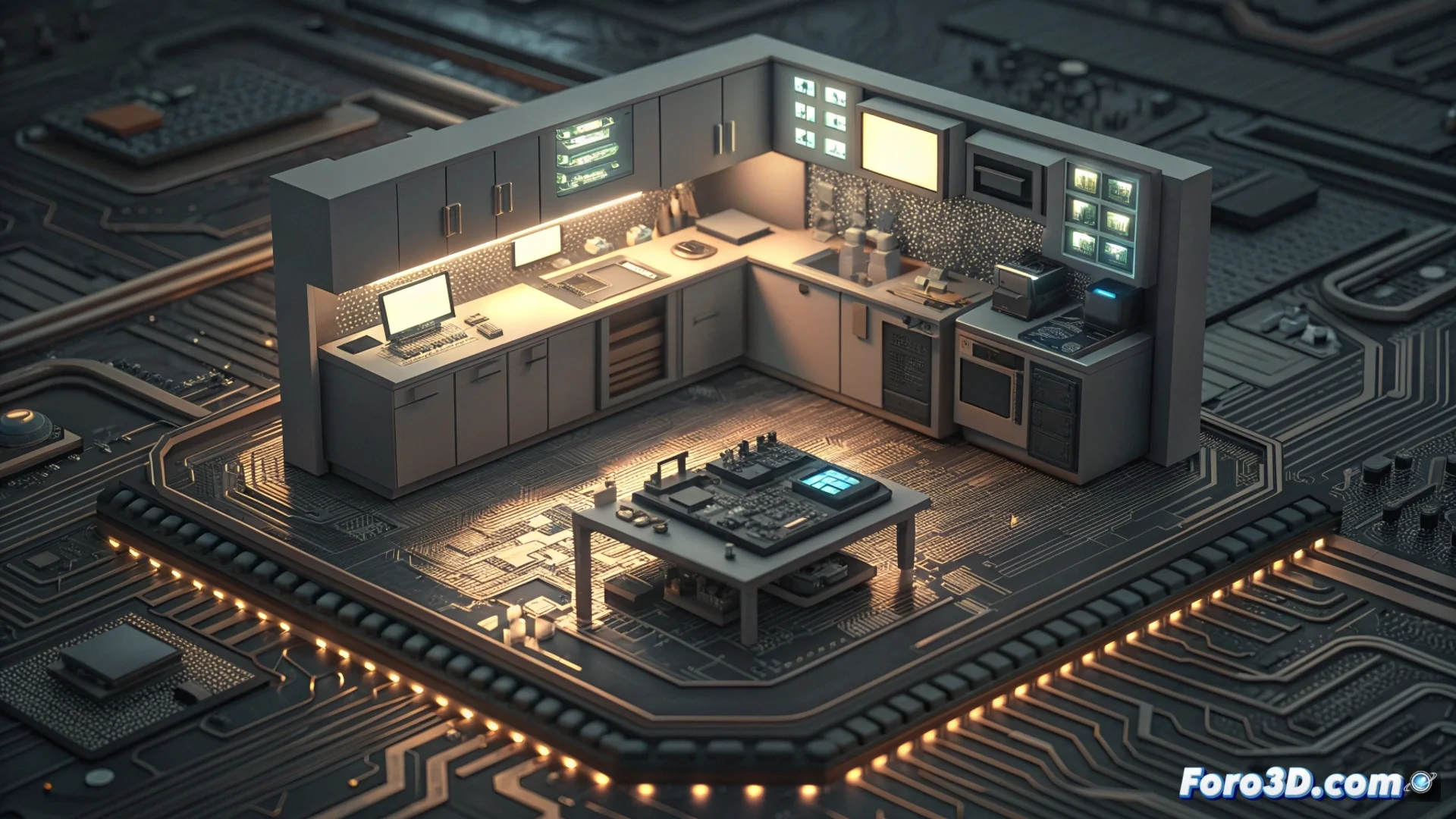

Entraîner des systèmes d'intelligence artificielle aujourd'hui fait face à un goulot d'étranglement similaire à cuisiner un banquet dans une cuisine minuscule : il faut beaucoup d'espace pour les ingrédients. Dans le monde du matériel, cet « espace » est la mémoire haute vitesse HBM, un composant cher et à offre limitée. La startup Positron AI, récemment devenue licorne, défie ce paradigme avec une proposition audacieuse : utiliser de la mémoire conventionnelle, mais à une échelle colossale. 🧠

La stratégie : prioriser la capacité sur la vitesse brute

Plutôt que l'exclusif et rapide Ferrari que représente la mémoire HBM, Positron mise sur une flotte de camions. Son nouveau accélérateur, dénommé Asimov, intégrera de grandes quantités de mémoire LPDDR5x, la même technologie efficace que celle utilisée dans les smartphones modernes, mais multipliée. L'objectif est d'incorporer plusieurs téraoctets de cette mémoire, une quantité énorme qui dépasse largement l'habitude. Cette approche de compromis échange un peu de vitesse pure contre une capacité massive, un coût moindre et une consommation énergétique plus efficace pour déplacer de grands volumes de données.

Avantages clés du modèle de Positron AI :- Réduire les coûts : La mémoire LPDDR5x est significativement moins chère que la HBM haut de gamme.

- Échelonner la capacité : Permet d'intégrer des téraoctets de mémoire, quelque chose de très complexe et coûteux avec la HBM.

- Améliorer l'efficacité : Gérer de grands modèles d'IA de manière plus durable énergétiquement.

C'est comme financer la construction d'un nouveau type d'avion des années avant qu'il ne vole.

Un calendrier qui reflète une ambition à long terme

Un dato qui surprend est l'horizon temporel du projet. Positron AI a obtenu 230 millions de dollars en financement sur la base de sa promesse, mais la puce Asimov ne sera prête pour ses premiers tests qu'à la fin du premier trimestre 2027. Ce délai démontre l'ampleur du défi technique et la foi des investisseurs dans la réinvention de l'infrastructure de base des centres de données pour l'IA, la libérant des composants traditionnels qui limitent sa croissance.

Implications de ce développement :- Démocratiser l'IA : Pourrait rendre l'entraînement de grands modèles plus accessible, pas seulement pour les géants technologiques.

- Changer le marché : Offrir une alternative réelle à la dépendance actuelle à la mémoire HBM rare.

- Accélérer l'innovation : En abaissant la barrière d'entrée, plus d'entreprises pourraient expérimenter avec l'IA avancée.

Le potentiel futur d'une idée simple

Si Positron AI réussit, nous pourrions assister à une démocratisation réelle de l'IA de haut niveau. Le paysage pourrait évoluer d'un environnement où seules quelques compagnies ont des superordinateurs, vers un modèle où l'on peut louer de la puissance d'IA de manière plus abordable et scalable. Dans un futur, votre assistant IA préféré pourrait fonctionner, en partie, grâce à une architecture inspirée de la mémoire de votre mobile, mais portée à une échelle véritablement titanesque. 🚀