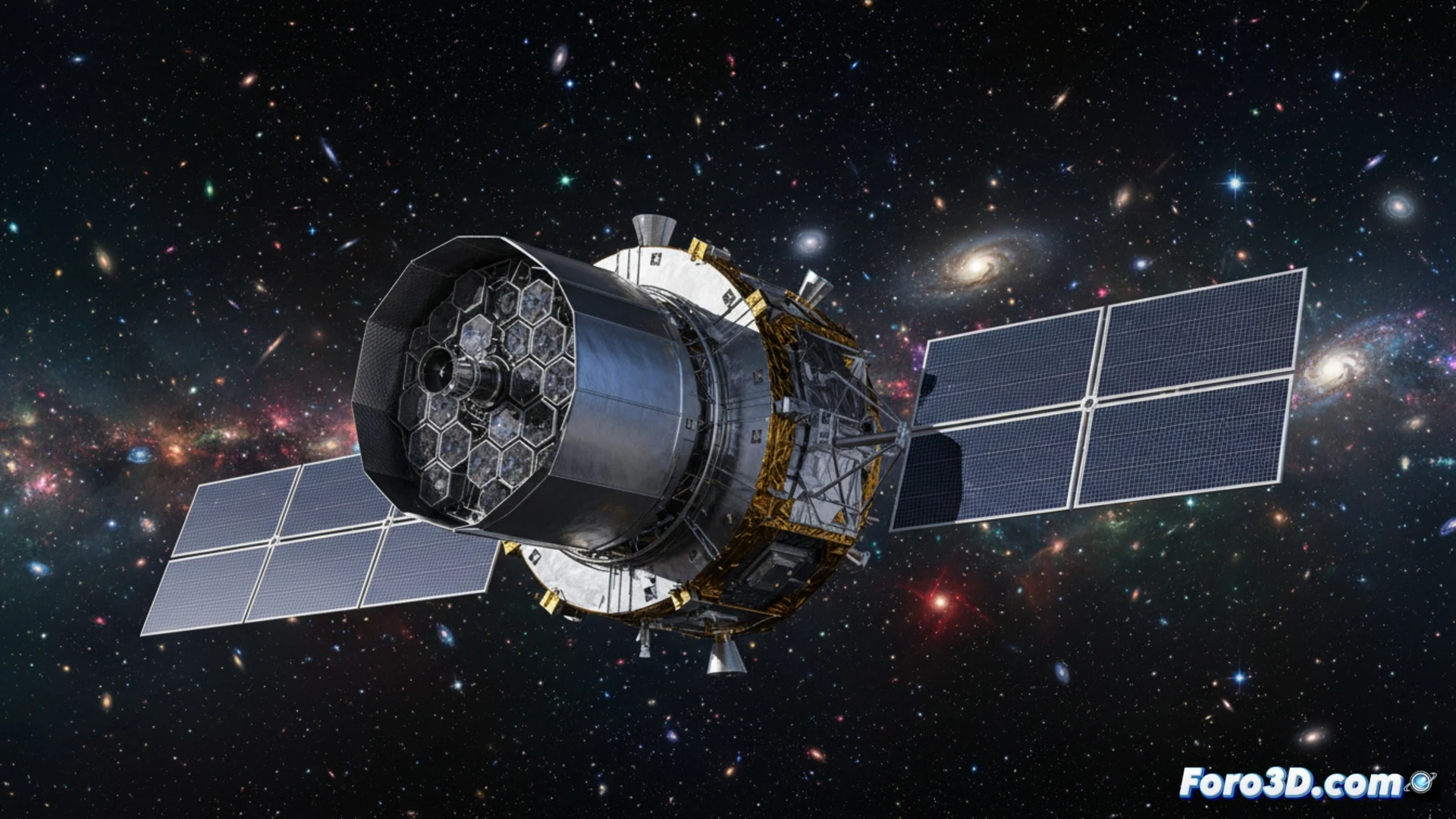

La NASA a confirmé le lancement du Télescope Spatial Nancy Grace Roman pour septembre 2026, un instrument qui révolutionnera la visualisation scientifique. Avec un champ de vision 100 fois supérieur à celui de Hubble et 50 fois à celui de James Webb, ses 18 détecteurs captureront des données de milliards de galaxies. Pour les experts en graphiques 3D, cela représente un défi et une opportunité : transformer ce flot d'informations en modèles volumétriques interactifs de l'univers à grande échelle.

Visualisation 3D de données massives : Du balayage au détail 🚀

Le Roman fonctionnera comme un scanner cosmique, balayant des étendues sans cible fixe. Dans le domaine de la visualisation 3D, cela implique de travailler avec des données de microlentille gravitationnelle et de transits planétaires. Des outils comme Blender avec des addons astronomiques ou des logiciels spécialisés comme AstroViz permettent de cartographier la position de dizaines de milliers d'exoplanètes dans un espace tridimensionnel. La clé réside dans la représentation de la complémentarité avec le James Webb : tandis que le Roman génère une carte de densité galactique à basse résolution, le Webb applique un zoom de haute précision. Les pipelines de rendu doivent gérer des niveaux de détail (LOD) qui alternent entre des nuages de points de milliards de galaxies et des modèles détaillés de supernovas individuelles.

Simuler l'invisible : L'art de l'échelle cosmique 🌌

Le véritable défi technique n'est pas seulement d'afficher des données, mais de simuler des phénomènes que l'œil humain ne peut pas capturer. Par exemple, la détection de planètes par microlentille nécessite d'animer des courbes de lumière en 3D et de déformer l'espace-temps autour des étoiles. Pour cela, on utilise des shaders volumétriques en temps réel (comme dans Unity ou Unreal Engine) qui représentent la courbure gravitationnelle. Le Roman nous oblige à penser en échelles : passer de la visualisation d'une nébuleuse au rendu d'un cube de 10 gigaparsecs. La communauté de Foro3D peut mener la création de prototypes interactifs qui montrent comment le balayage du Roman et le zoom du Webb se complètent, en utilisant des données simulées de la NASA.

Comment les données tridimensionnelles du Télescope Roman seront-elles intégrées aux systèmes de visualisation scientifique existants, comme Unity ou Blender, pour permettre aux chercheurs d'explorer en temps réel la structure massive du cosmos ?

(PS : sur Foro3D, nous savons que même les raies manta ont de meilleurs liens sociaux que nos polygones)