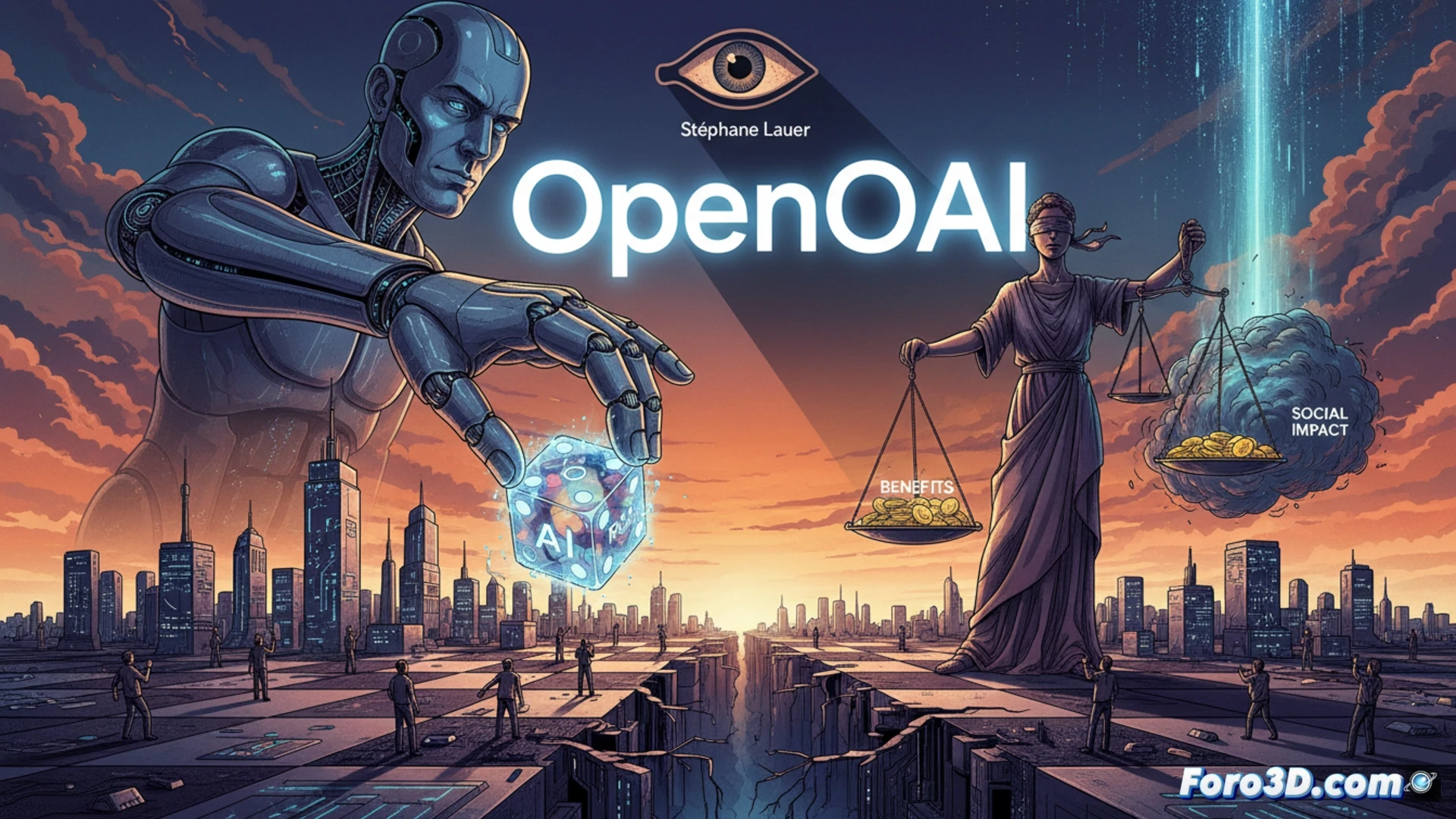

L'avancée de l'intelligence artificielle suscite un débat crucial sur sa gouvernance. Stéphane Lauer, dans une récente chronique, interroge la capacité d'entreprises privées comme OpenAI à gérer les risques sociaux et à distribuer les bénéfices de cette technologie. L'avertissement est clair : il existe un danger à ce que ceux qui développent les outils établissent également les règles du jeu, agissant comme juge et partie dans un domaine à impact mondial.

L'architecture de l'opacité et du contrôle centralisé 🤖

Le modèle de développement actuel repose sur des systèmes de boîte noire et des ressources computationnelles massives, centralisées dans quelques entités. Cette concentration technique et de données crée une asymétrie de pouvoir. Le paradoxe est que les mêmes équipes qui conçoivent des algorithmes complexes et définissent les limites de leurs assistants sont ensuite celles qui proposent des cadres éthiques et de sécurité. Ce manque de séparation suscite des doutes sur la transparence et les incitations réelles derrière chaque décision technique ou politique.

Fais-moi confiance, je suis un loup construisant la bergerie 🐺

La situation a un air de fable moderne. Les entreprises qui se font une concurrence féroce pour la domination du marché se parent soudainement de la toge de philosophes soucieux du bien commun. C'est comme si les constructeurs automobiles, après des années à vendre de la vitesse, se portaient volontaires pour rédiger le code de la route, en s'assurant que leurs modèles les plus puissants auraient une voie spéciale. Une stratégie de relations publiques si brillante que leurs propres IA la signeraient.