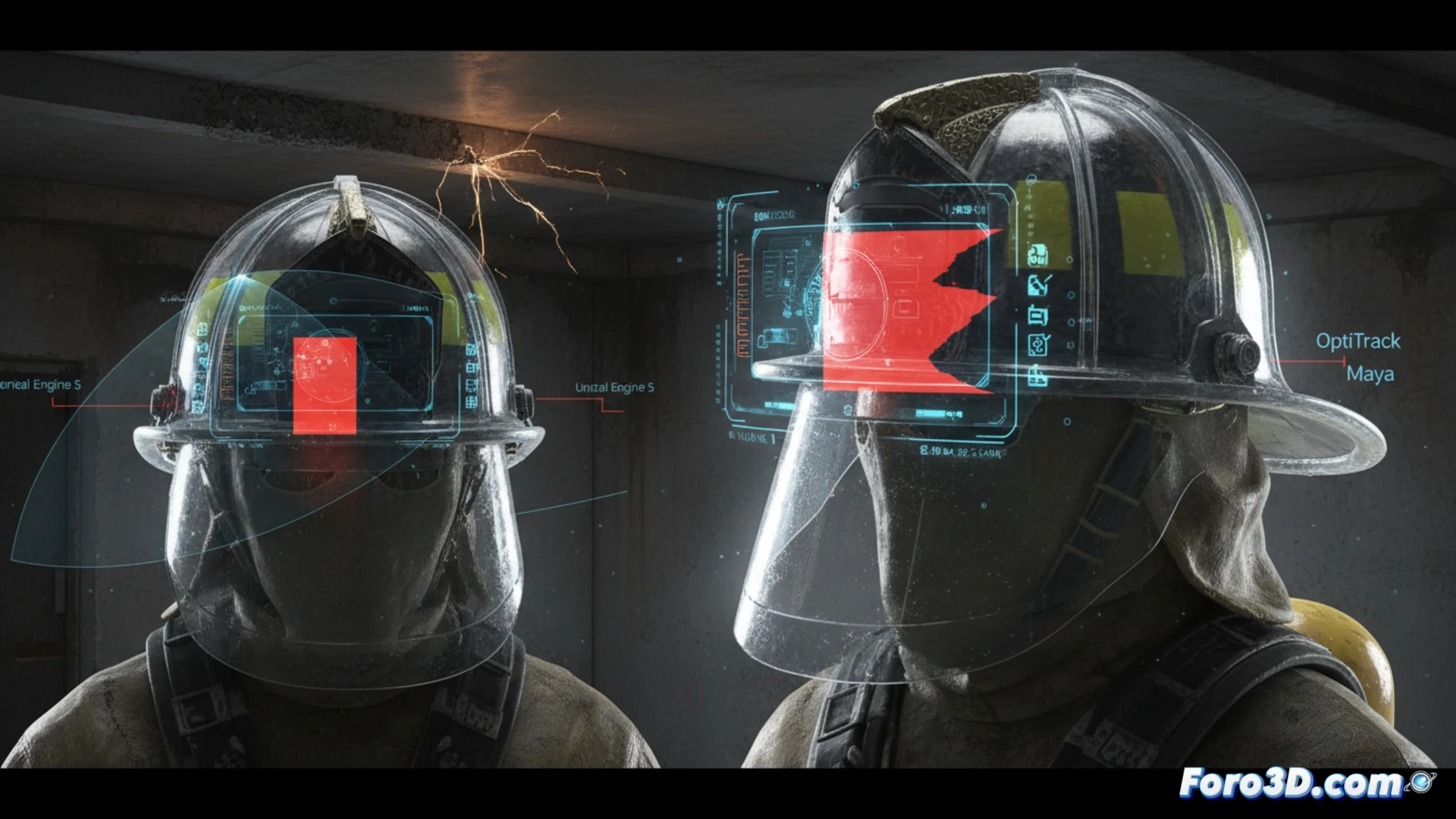

Ein kürzlicher Unfall bei einer Rettungsübung hat die Sicherheit von Augmented-Reality-Schnittstellen in feindlichen Umgebungen unter die Lupe genommen. Ein Feuerwehrmann, ausgestattet mit einem Helm mit AR-Display, erkannte ein Hindernis nicht, das sein eigenes HUD in seiner Peripherie verdeckte. Die Nachstellung des Vorfalls in Unreal Engine 5 mit Bewegungsdaten von OptiTrack ergab, dass ein kritisches Statuspanel genau den Bereich blockierte, in dem die Gefahr auftrat.

3D-Nachstellung des Fehlers: Unreal Engine 5 und OptiTrack als forensische Werkzeuge 🛠️

Um das Ausmaß des Problems zu demonstrieren, modellierten wir die Szene in Maya und importierten sie in Unreal Engine 5. Wir verwendeten OptiTrack-Daten, um die Position des Kopfes und des Helms des Feuerwehrmanns während des Vorfalls präzise zu replizieren. Das Ergebnis war erschreckend: Das Temperatur- und Druck-Overlay, das statisch in der oberen rechten Ecke positioniert sein sollte, drang in 35 % des Sichtfelds ein, als der Benutzer den Kopf drehte, um einen Balken zu inspizieren. Die Simulation zeigte, dass die AR-Schnittstelle im Sekundenbruchteil vor dem Aufprall wie ein digitaler Vorhang wirkte und die visuellen Informationen entfernte, die zur Beurteilung der Entfernung notwendig waren.

Hin zu einem adaptiven Design: Transparenz und dynamische Neupositionierung 💡

Die Lösung besteht nicht darin, Informationen zu entfernen, sondern ihre räumliche Hierarchie zu verwalten. Ich schlage drei praktikable Verbesserungen vor: adaptive Transparenz, die die Deckkraft nur erhöht, wenn der Benutzer das Element fixiert, dynamische Neupositionierung, die die Panels an die äußersten Ränder des Sichtfelds verschiebt, wenn schnelle Kopfbewegungen erkannt werden, und ein Okklusionswarnsystem, das eine halbtransparente Kontur des realen Hindernisses auf das HUD projiziert. Diese Änderungen, die mit OptiTrack und Maya validiert werden können, könnten ein gefährliches HUD in einen Assistenten verwandeln, der niemals den Blick von der Gefahr nimmt.

In Anbetracht des Unfalls bei der Rettungsübung, bei dem die visuelle Okklusion des HUD versagte, wie sollten die Designprotokolle überdacht werden, um sicherzustellen, dass kritische Informationen nicht reale Gefahren der Umgebung überdecken?

(PS: Die AR, die bei der Wartung angewendet wird, ermöglicht es Ihnen, den Fehler zu sehen... bevor die Maschine explodiert.)