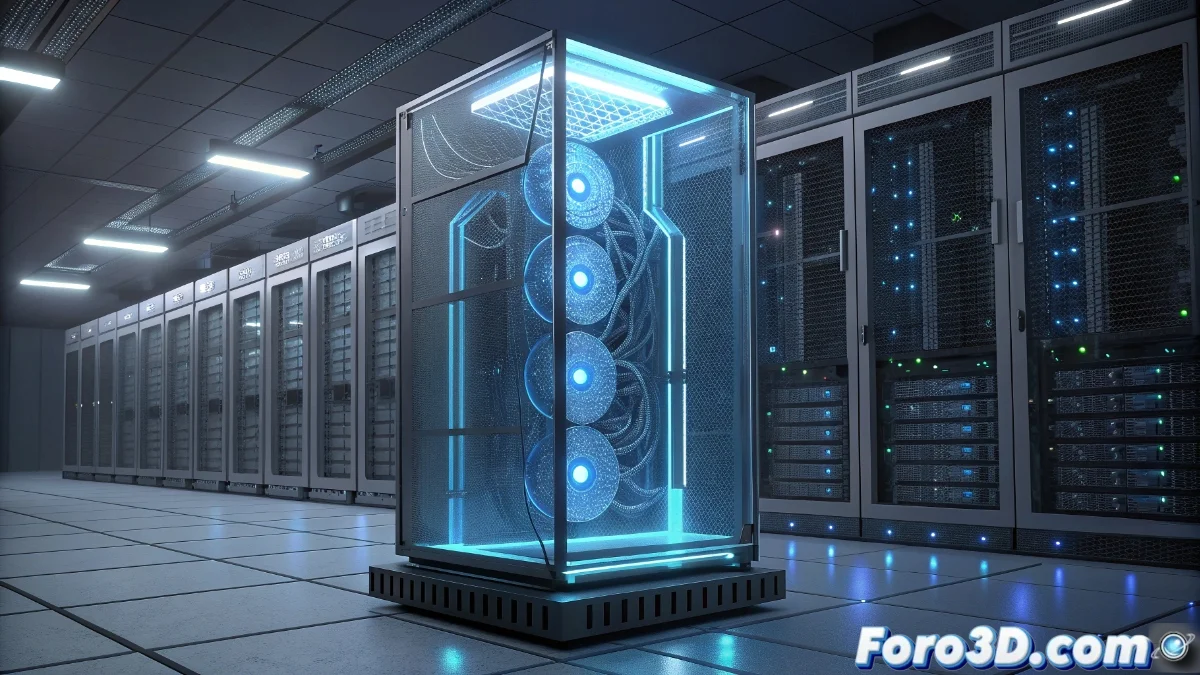

NVIDIA DGX A100 服务器:人工智能的全面计算能力

专用 NVIDIA DGX A100 服务器 是一个专为大规模训练和人工智能系统部署而设计的完整解决方案。该平台集成了八个通过 NVLink 技术连接的 A100 图形处理单元,创造了一个前所未有的并行计算生态系统。🚀

先进的计算架构

八个 A100 GPU 之间的 NVLink 互连建立了一个统一内存域,彻底革新了数据处理。这种配置完全消除了传统信息传输中的瓶颈,使最复杂的深度学习模型能够在显著缩短的时间内完成训练。

系统关键组件:- 八个带高速 NVLink 互连的 NVIDIA A100 GPU

- 用于集中管理的 AMD EPYC 高性能处理器

- 1 TB RAM 用于处理海量数据集

- NVMe 存储用于超高速传输

- 先进的冷却系统以实现最大能源效率

- 针对 TensorFlow、PyTorch 和其他框架的原生优化

设计固有的分布式处理能力便于处理超过 TB 级的数据集,同时通过最新一代冷却技术保持最佳能源效率。

专业环境中的应用

该系统专为高级研究项目设计,在这些项目中,模型规模或数据量对于传统基础设施来说是无法处理的。大学和技术公司使用 DGX A100 来开发自然语言系统、自动驾驶车辆的计算机视觉以及复杂的科学模拟。

主要用例:- 工业规模的自然语言模型开发

- 自动驾驶汽车的计算机视觉系统

- 科学模拟和高级研究

- 通过虚拟化执行多个工作负载

- 实时推理过程的延迟降低

- 海量批处理中的吞吐量提升

实施的实际考虑

GPU 虚拟化 允许同时执行多个工作负载,使该平台成为开发和生产环境的通用解决方案。必须考虑,当所有 GPU 以最大容量运行时,能耗 需要专用电力基础设施,相当于中等规模工业设施的能耗。⚡