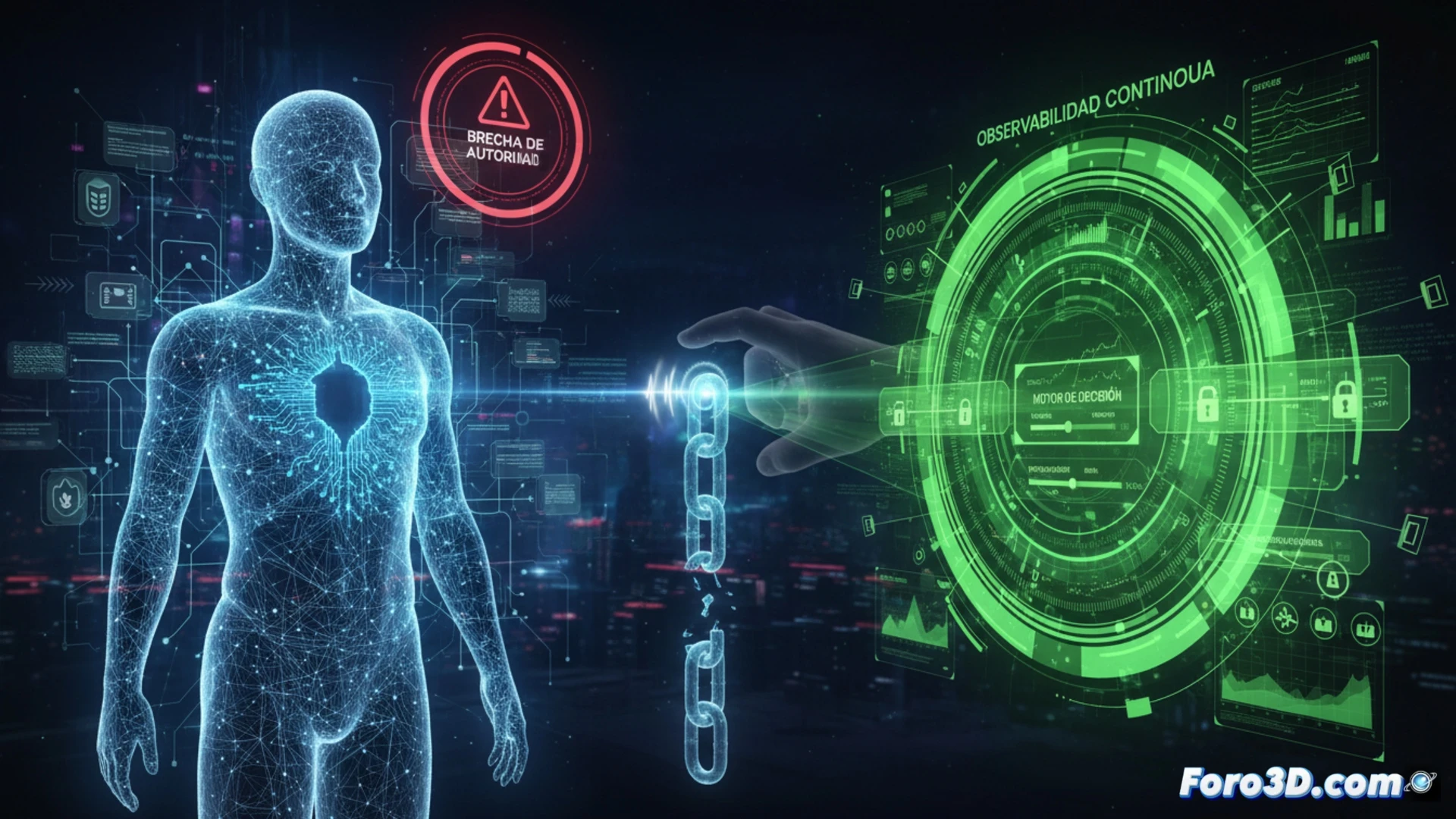

人工智能代理的兴起带来了一个超越其新颖性的问题:它们通过委托行事,而非凭借自身权威。它们由系统和用户激活、调用或配置,从而在企业安全中造成了结构性缺口。如果没有对支持它们的人或事进行明确控制,它们的决策可能会产生不可预见的风险。

持续可观测性作为决策引擎以弥合差距 🔍

为了弥合这一差距,持续可观测性成为实用的解决方案。它允许实时监控代理的每个动作,从其调用到任务执行。凭借这种可见性,可以评估其行为、检测偏差并动态调整权限。这不是盲目信任,而是不断验证每一步是否符合组织的安全策略。

人工智能代理没有老板,但你肯定会有麻烦 😅

结果发现,这些代理就像那个充满热情但没带说明书的实习生。它们通过委托行事,但如果出了问题,责任在你。它们没有自身权威,却有删除数据或发送有风险邮件的能力。最终,可观测性不是奢侈品:它是防止你的人工智能代理决定今天是个关闭公司的好日子的保险。