Micron 推出 HBM3 Gen2 以加速人工智能

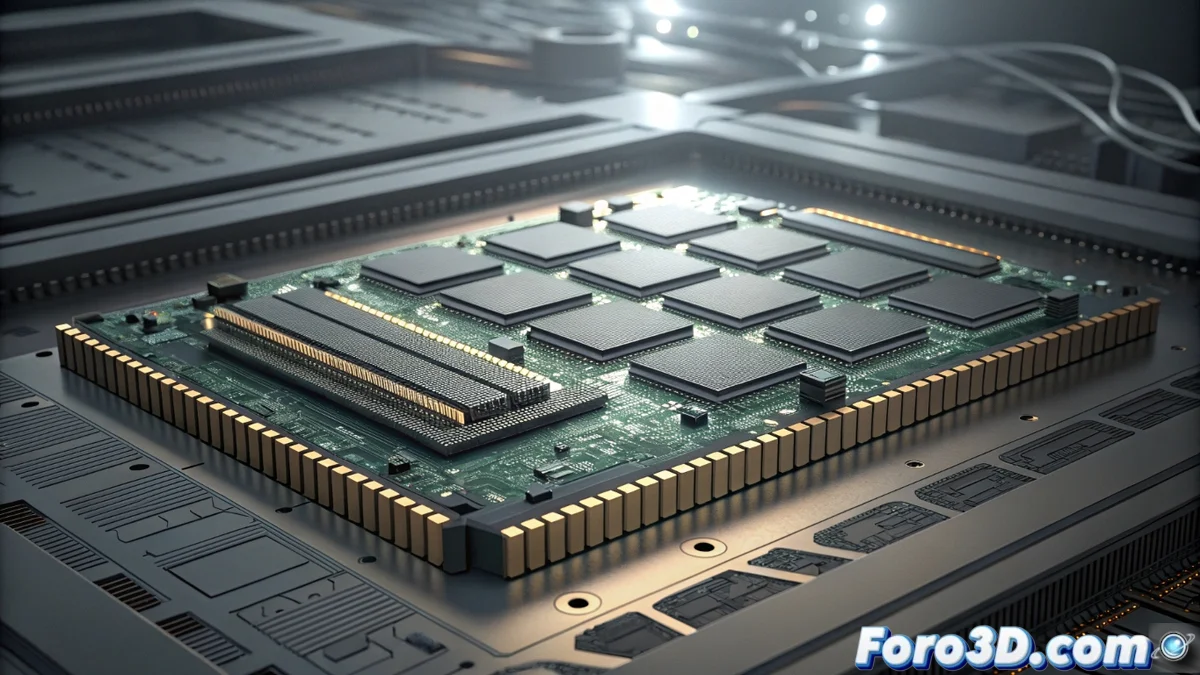

大规模数据处理的竞赛因 Micron 宣布其 HBM3 Gen2 内存而获得新动力。该技术在高带宽领域取得了重大进步,专为下一代GPU和专用于人工智能的加速器而设计。其目标是克服当前的瓶颈,实现更快、更高效的信息流,以处理极端工作负载 🚀。

规格和改进的架构

HBM3 Gen2 的技术特性设定了新标准。每个堆栈内存能够支持高达 819 GB/s 的传输速度,而每个单元的密度高达 64 GB。这一量化飞跃对于管理机器学习和科学计算所需的海量数据集至关重要。该架构基于3D 堆叠,不仅压缩了容量,还优化了能耗并改善了热消散,这是数据中心的关键因素。

架构的关键进步:- 超高性能接口,每堆栈 819 GB/s。

- 每个设备 64 GB 高密度,便于紧凑配置。

- 3D 堆叠技术,提高能效和热性能。

HBM3 Gen2 与前沿芯片的集成确保带宽与关键应用中更高时钟速度的需求相匹配。

对前沿硬件的影响

在先进硬件中,这种内存找到了最直接的应用。神经模型训练的GPU和AI 加速器将是主要受益者,因为它们可以不间断地处理大量信息。Micron 设计了这一解决方案,以实现与市场上最强大处理器的无缝集成,确保系统性能受计算能力而非内存速度限制。行业报告强调了其在高性能计算 (HPC) 基础设施开发中的关键作用。

主要应用:- AI 训练和大语言模型 (LLMs)。

- 高性能计算 (HPC),用于科学模拟。

- 实时数据分析和密集型工作负载。

永无止境的技术竞赛

HBM3 Gen2的推出突显了创新的无情动态。尽管它在速度和容量方面设定了新基准,但悖论依然存在:AI 算法的贪婪需求可能在不久的将来超过这些标准。这一循环反映了技术的本质,不断向移动的地平线推进,推动行业寻求越来越强大和高效的解决方案。Micron 的赌注巩固了下一波将转型各行业的 AI 应用的基础 🤖。