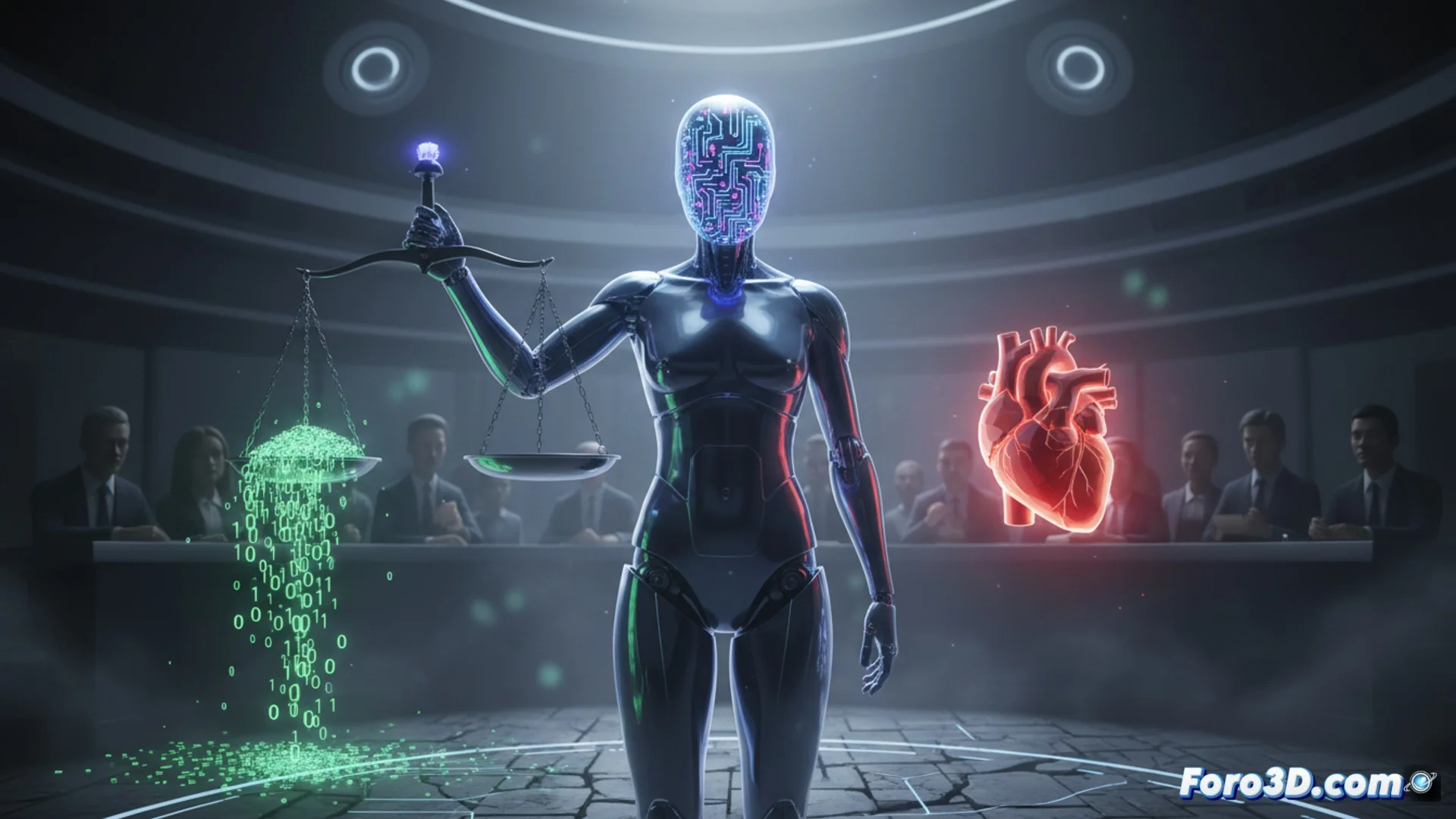

人工智能系统中的伦理与责任

人工智能系统如今在关键领域做出决定,从批准贷款到检测医疗疾病。这引发了激烈的公众辩论,关于伦理原则,尤其是当事情出错时,谁应该负责。讨论不仅仅围绕机器本身,而是围绕那些编程、提供数据并启动它的人。🤖

根本问题:带有偏见的數據

AI算法只能从它接收的信息中学习。如果历史数据集包含人类歧视,系统将倾向于复制甚至放大它们。这并不使机器“坏”,而是暴露了其设计中的缺陷。因此,首要义务在于那些选择信息并设定模型目标的人。

缓解风险的关键措施:- 持续审计数据收集和处理方式。

- 明确定义算法应追求的目标。

- 监督结果,以及时识别不良偏差。

认为算法默认中立,就如同期待一本说明书能自己写出来一样不准确。客观性是一个目标,而不是起点。

需要填补的法律空白

当自动化决策造成损害时,确定责任变得异常困难。是开发代码的团队、实施系统的组织,还是未经分析就使用它的操作者负责?新兴法规,如欧盟AI法案草案,试图根据风险水平创建责任框架。然而,在具体情况下将这些规范付诸实践是一个巨大的法律挑战,鉴于决策链的模糊性质。⚖️

潜在责任实体:- 创建和训练模型的开发团队和工程师。

- 部署和使用系统的公司或机构。

- 没有自身判断就应用算法推荐的最终用户。

结论:共享责任

关于AI伦理的讨论超越了技术层面。它强调技术是背后人类决策的反映。因此,确保这些系统公平行事需要持续的集体努力:从审计输入数据到定义清晰的法律框架。责任不是软件的属性,而是设计、治理和使用它的人的义务。