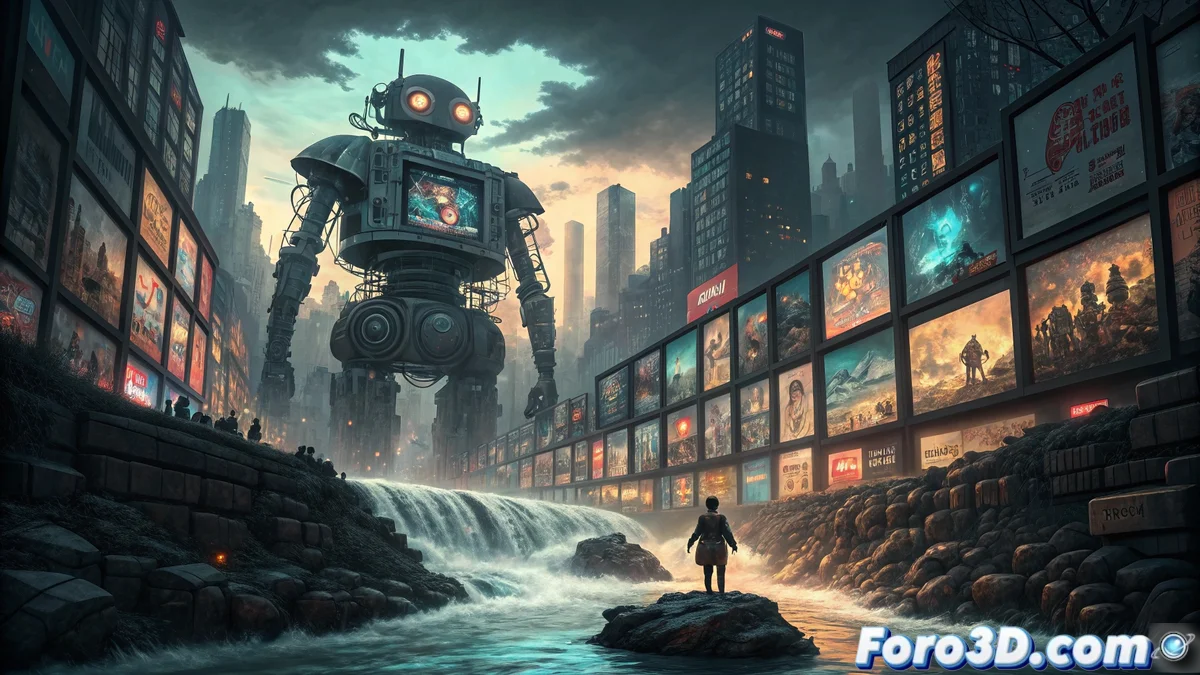

OpenAI 版权政策的含义

生成式人工智能世界中争议四起。🎬 OpenAI 宣布,其视频生成工具 Sora 将默认包含受版权保护的内容,除非权利持有人明确要求排除。此政策意味着电影、电视剧、艺术作品和其他受版权保护的材料可能出现在用户创建的视频中,而无需事先授权。保护的责任完全落在原创创作者身上,他们必须为每件特定作品进行正式程序。此外,OpenAI 不接受涵盖艺术家全部作品的通用请求,而是要求对每个要排除的元素进行详细指定。

现有保护和例外

尽管存在争议,该政策仍包括一些有限的保障措施。OpenAI 规定,不会生成包含可识别公众人物的视频,除非获得其明确同意,此举旨在防止未经授权的深度伪造视频生成。该系统生成的视频还将有持续时间限制,根据可用文档,最长为十秒。该实施将随着产品新版本逐步进行,已知案例包括迪士尼等公司,已成为首批要求将其内容从训练系统中排除的公司。

权利持有人必须明确要求其作品不被使用

艺术家为何需要担心

此政策对专业和独立创意社区构成多重具体威胁。默认包含的方法意味着,如果创作者不主动行动,其作品可能在未经许可的情况下被使用。排除过程对拥有大量作品集的艺术家来说特别繁琐,因为他们必须逐一指定每件要保护的作品。这种动态将预防责任转移到补救上,造成未经授权的使用先发生,而保护则需要创作者额外努力。

自动化脱自动化的悖论

一种专门设计用于自动化创意过程的 AI 工具,最终却为人类创作者制造额外的手动工作,这其中蕴含着深刻的讽刺意味。虽然 Sora 承诺通过简单提示生成复杂视频,但艺术家们必须投入详细的官僚程序来保护其知识产权。这种矛盾揭示了创作自动化的同时,保护可能会脱自动化,将工作负担重新分配到意想不到且可能不公的方向。

迪士尼案例作为行业晴雨表

迪士尼迅速要求排除其内容的行为,是行业内风险认知的重要指标。一个拥有无限法律资源和庞大目录的巨头认为有必要立即行动,这表明了感知到的威胁规模。然而,这也引发疑问:大公司是否谈判了比个人创作者更高效的排除流程,从而创造了一个双速系统,其中最脆弱者承担最大官僚负担。

受影响创作者的推荐

希望保护自己作品的艺术家面临复杂局面,需要战略行动和细致文档。

- 详尽文档: 保持所有作品的详细记录,包括创作和发布日期

- 排除的具体性: 准备精确的作品排除列表,包含所有相关元数据

- 持续监控: 注意 OpenAI 关于政策和程序更新的通信

- 集体行动: 考虑与艺术家协会合作谈判群体排除

实用保护策略

有效应对这一新局面需要技术和组织方法。

- 建立便于精确识别作品排除的目录系统

- 制定内部协议,以快速响应 AI 平台政策变化

- 探索水印和嵌入元数据选项,这些能在训练过程中存活

- 参与生成式 AI 时代权利管理的行业标准讨论

法律和监管含义

此政策很可能加速 AI 时代版权基本法律辩论。

- 对公平使用和转化性原则兼容性的质疑

- 压力更新未预见 AI 训练技术的法律框架

- 创作者公会和协会可能的集体诉讼

- 关于 AI 训练中使用作品知情同意标准的演变

创新与保护平衡的未来

Sora 案例代表生成式技术与知识产权关系的一个转折点。

- 可能出现基于 opt-in 而非 opt-out 的替代模型

- 开发技术工具,便于创作者大规模管理排除

- 为作品供养 AI 系统的创作者开发补偿模型

- 重新评估 AI 模型训练语境中何为转化性使用

当 OpenAI 自动化视频创作时,艺术家们发现保护自己的工作已成为额外的手动劳动。🎨 因为,老实说,还有什么比一个创造新内容的 AI 让人类做更多文书工作的更讽刺的事吗?