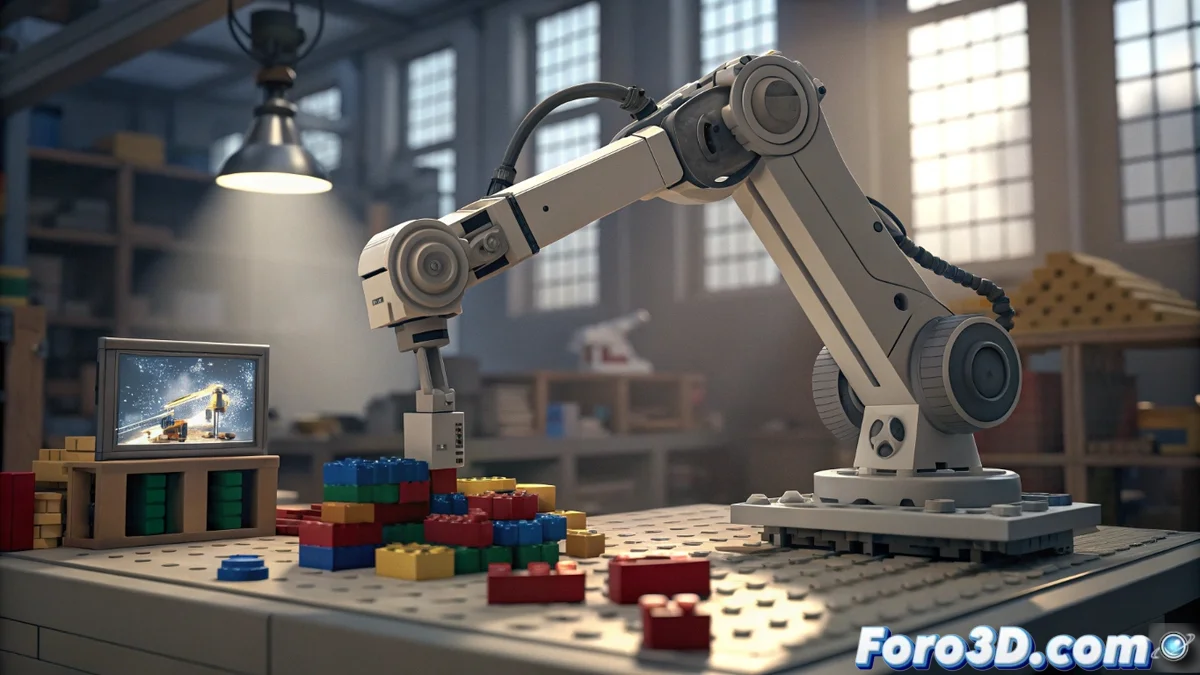

ManualVLA:一个使用多模态手册提升机器人规划的框架

视觉-语言-动作(VLA) 模型以其泛化能力著称,但面对需要明确目标状态的复杂任务时会遇到困难,例如组装结构或重新组织物体。其主要挑战是协调高层规划与精确操作。为了解决这个问题,提出了ManualVLA,一个统一的框架,使 VLA 模型能够从结果什么中推断过程如何,将抽象目标转化为可执行动作序列。🤖

具有两个专家和引导推理的架构

ManualVLA 基于Transformer 混合(MoT)架构。与直接将感官感知映射到电机命令不同,它引入了一个关键的中间步骤。首先,规划专家生成中间多模态手册。这些手册整合了图像、空间指示和文本指令。然后,手册思维链(ManualCoT)过程将这些手册引导至动作专家。手册的每个步骤提供明确的控制条件,而其潜在表示作为隐式引导以实现精确操作。

系统关键组件:- 规划专家:生成详细手册,将最终任务分解为可理解和可执行的步骤。

- ManualCoT:一个推理机制,结构化和将手册信息输入到执行动作的专家。

- 动作专家:将手册的多模态指令转化为精确协调的机器人运动。

ManualVLA 在 LEGO 组装和物体重新组织任务中,比之前最佳层次模型平均成功率高 32%。

自动生成训练数据

训练规划专家需要大量手册数据,手动收集成本很高。为了克服这一障碍,团队开发了一个基于3D Gaussian Splatting技术的数字孪生工具包。该工具包自动生成高保真手册数据,从而高效、可扩展地训练规划器,而无需依赖大量人工标注。

数字孪生工具包的优势:- 创建逼真、多样的合成数据,用于训练复杂规划模型。

- 大幅减少收集真实世界数据相关的负担和成本。

- 允许在模拟环境中测试和完善手册,然后再进行物理执行。

影响和未来展望

这种方法不仅提升了机器人规划和执行复杂操作任务的方式,还简化了从零开始编程它们以遵循指令的过程。通过弥合最终目标与实现所需步骤之间的差距,ManualVLA 代表了朝着更自主、更强大的机器人的重大进步。该框架确立了一个新范式,其中生成清晰程序是实现稳健可靠机器人操作的核心。🧩