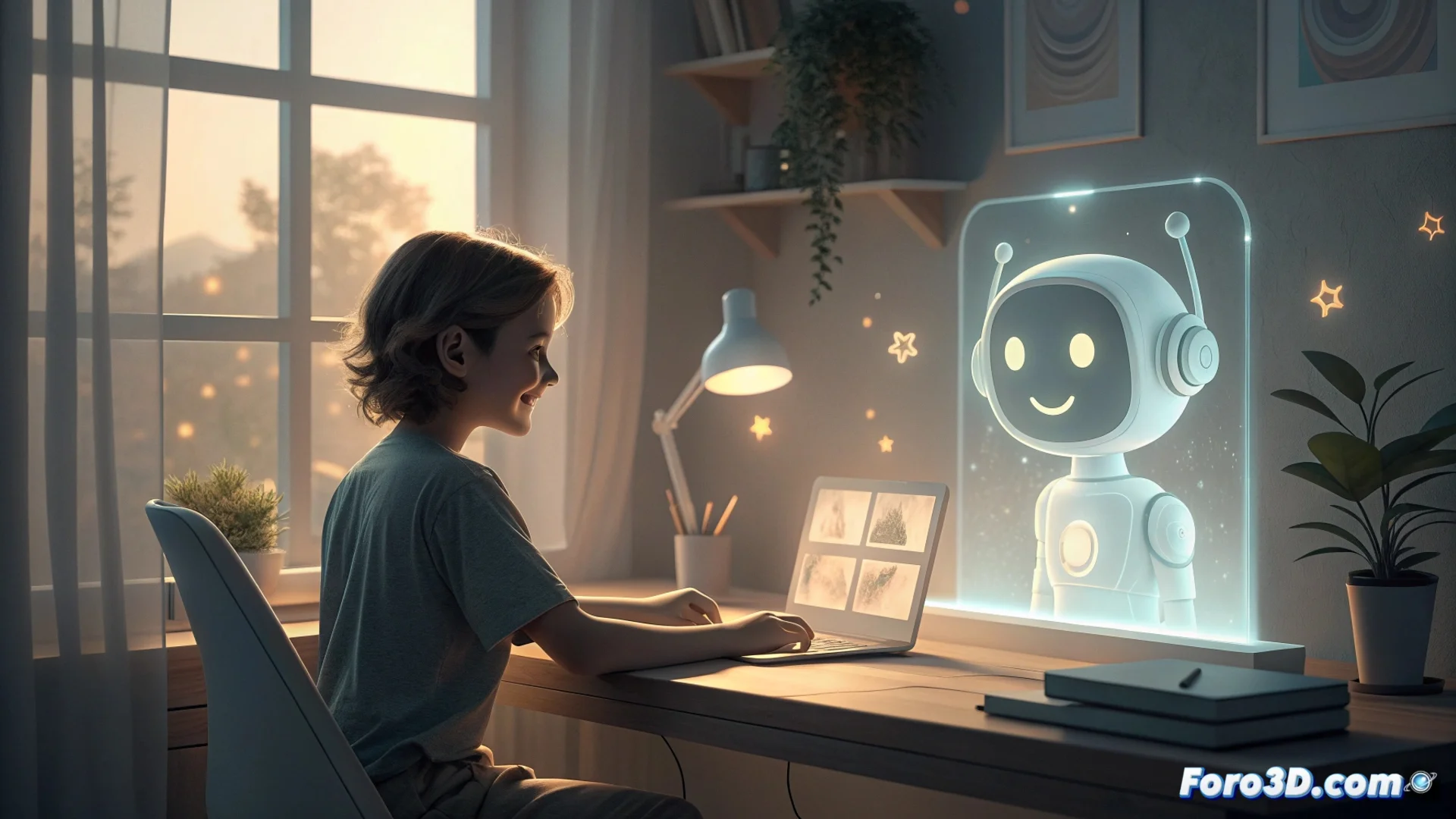

يحدّث OpenAI نموذج GPT-5.2 بحمايات خاصة للقاصرين

لقد أطلقت OpenAI إصدارًا جديدًا من نموذج اللغة GPT-5.2، مع دمج حمايات مصممة خصيصًا لحماية المستخدمين المراهقين بشكل أولوي. تأتي هذه المبادرة بعد التعاون المباشر مع الجمعية الأمريكية لعلم النفس لإقامة بروتوكولات سلوك أكثر أمانًا، وهي رد مباشر على القلق الاجتماعي والقانوني المتزايد. 🛡️

آليات الكشف والاستجابة التكيفية

يدمج النظام الآن وظائف لـكشف العمر التقريبي للمستخدم، وبالتالي تعديل طريقة تفاعله. عند تحديد قاصر، يعدّل النموذج ردوده لتجنب التعمق في محادثات حول الإيذاء الذاتي، أو العنف الصريح، أو المحتوى الجنسي. بدلاً من إنتاج ردود قد تمجّد سلوكيات خطيرة، يُبرمج الدردشة الآلي لإعادة توجيه الحوار.

الإجراءات الرئيسية للنظام المحدّث:- يحدّ أو يقطع الردود حول مواضيع حساسة عاطفيًا.

- يقدّم اقتراحات للاتصال بخطوط المساعدة أو بالبالغين الموثوقين.

- يتجنّب إنتاج محتوى قد يفاقم أزمة شخصية.

يبدو الشعار التشغيلي الجديد واضحًا: إذا لم يتمكن الروبوت من حل أزمتك المراهقة، فسوف يرشدك على الأقل للبحث عن مساعدة بشرية.

سياق الضغط القانوني والتنظيمي

هذا التغيير ليس معزولًا. يحدث في وقت يناقش فيه عدة ولايات في الولايات المتحدة بشكل نشط قوانين لتنظيم الذكاء الاصطناعي، مع تركيز خاص على حماية الشباب في البيئات الرقمية. يأتي قرار OpenAI بعد دعاوى قضائية قدمتها عائلات ادّعت أن تفاعلات سابقة مع الدردشة الآلي ساهمت في مآسي شخصية، رابطة استخدامه بحالات الذهان والانتحار.

العوامل التي دفعّت التحديث:- الضغط المستمر من المشرّعين القلقين بشأن مخاطر الذكاء الاصطناعي.

- الدعاوى القضائية التي تشير إلى ضرر محتمل للقاصرين.

- الحاجة إلى إقامة معيار رعاية استباقية في الصناعة.

التوازن بين الأمان والفعالية

من خلال الشراكة مع خبراء علم النفس، تسعى OpenAI إلى تخفيف المخاطر المحتملة وتحديد نموذج جديد للمسؤولية. ومع ذلك، يشير بعض المحلّلين والنقّاد إلى أن هذه الإجراءات التقنية يمكن الالتفاف عليها أو أنها غير مضمونة، مما يثير شكوكًا حول فعاليتها على المدى الطويل. تبدو الشركة تُعطي الأولوية لإظهار جهد الاجتهاد الواجب في مشهد تنظيمي أكثر صرامة يومًا بعد يوم. الهدف النهائي واضح: إنتاج مساعد ذكاء اصطناعي قوي يُعطي الأولوية، في حال الشك، لأمان المستخدم الأكثر ضعفًا. 🤖➡️👨👩👧👦