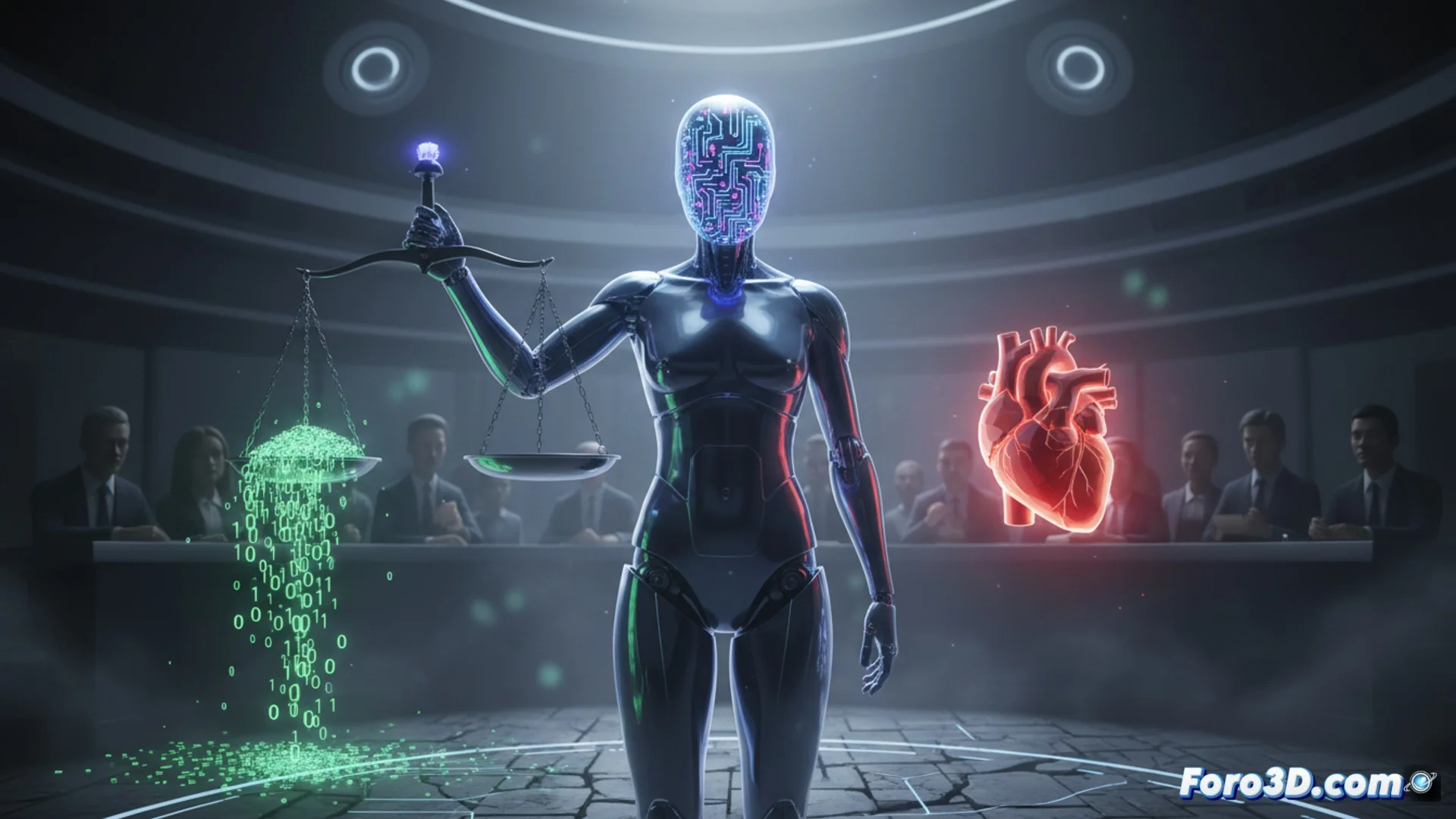

الأخلاقيات والمسؤولية في أنظمة الذكاء الاصطناعي

تتخذ أنظمة الذكاء الاصطناعي الآن قرارات في مجالات حيوية، من منح القروض إلى كشف الأمراض الطبية. هذا يولد نقاشًا عامًا شديدًا حول المبادئ الأخلاقية، وعلى وجه الخصوص، حول من يجب أن يتحمل المسؤولية عندما تسوء الأمور. لا يدور الحديث فقط حول الآلة، بل حول الأشخاص الذين يبرمجونها، ويغذونها بالبيانات، ويضعونها في التشغيل. 🤖

المشكلة الأساسية: البيانات ذات التحيزات

لا يمكن لخوارزمية الذكاء الاصطناعي سوى التعلم من المعلومات التي يتلقاها. إذا كانت مجموعات البيانات التاريخية تشمل تمييزات بشرية، فإن النظام سيميل إلى تكرارها وحتى تعزيزها. هذا لا يجعل الآلة "شريرة"، بل يكشف عن العيوب في تصميمها. لذلك، تكمن الالتزام الأولي لدى من يختارون المعلومات ويحددون أهداف النموذج.

إجراءات رئيسية لتخفيف المخاطر:- التدقيق المستمر في كيفية جمع البيانات ومعالجتها.

- تحديد الأهداف التي يجب أن يسعى إليها الخوارزمي بوضوح.

- مراقبة النتائج لتحديد الانحرافات غير المرغوب فيها في الوقت المناسب.

التفكير بأن الخوارزمية محايدة افتراضيًا هو أمر خاطئ مثل الانتظار أن يكتب دليل التعليمات نفسه. الموضوعية هدف، وليست نقطة انطلاق.

فراغ قانوني يجب ملؤه

عندما تسبب قرار آلي ضررًا، يصبح تحديد الذنب مهمة شاقة. هل يجب أن يتحمل المسؤولية الفريق الذي طور الكود، أم المنظمة التي نفذته، أم المشغل الذي استخدمه دون تحليله؟ اللوائح الناشئة، مثل مسودة قانون الذكاء الاصطناعي في الاتحاد الأوروبي، تحاول إنشاء إطارات مسؤولية وفقًا لمستوى المخاطر. ومع ذلك، تطبيق هذه اللوائح في المواقف الملموسة يمثل تحديًا قانونيًا هائلاً، نظرًا لطبيعة السلسلة التصرفية الغامضة. ⚖️

الجهات المحتمل مسؤوليتها:- فرق التطوير والمهندسين الذين ينشئون ويدربون النماذج.

- الشركات أو المؤسسات التي تنشر وتستخدم النظام.

- المستخدمون النهائيون الذين يطبقون توصيات الخوارزمي دون معيار خاص بهم.

الخاتمة: مسؤولية مشتركة

يتجاوز النقاش حول أخلاقيات الذكاء الاصطناعي الجانب التقني. يؤكد أن التكنولوجيا انعكاس للقرارات البشرية التي تقف خلفها. لذلك، ضمان أن تعمل هذه الأنظمة بشكل عادل يتطلب جهدًا مستمرًا ومشتركًا: من تدقيق بيانات الإدخال إلى تحديد إطارات قانونية واضحة. المسؤولية ليست خاصية للبرمجيات، بل واجب على من يصممونها ويحكمونها ويستخدمونها.