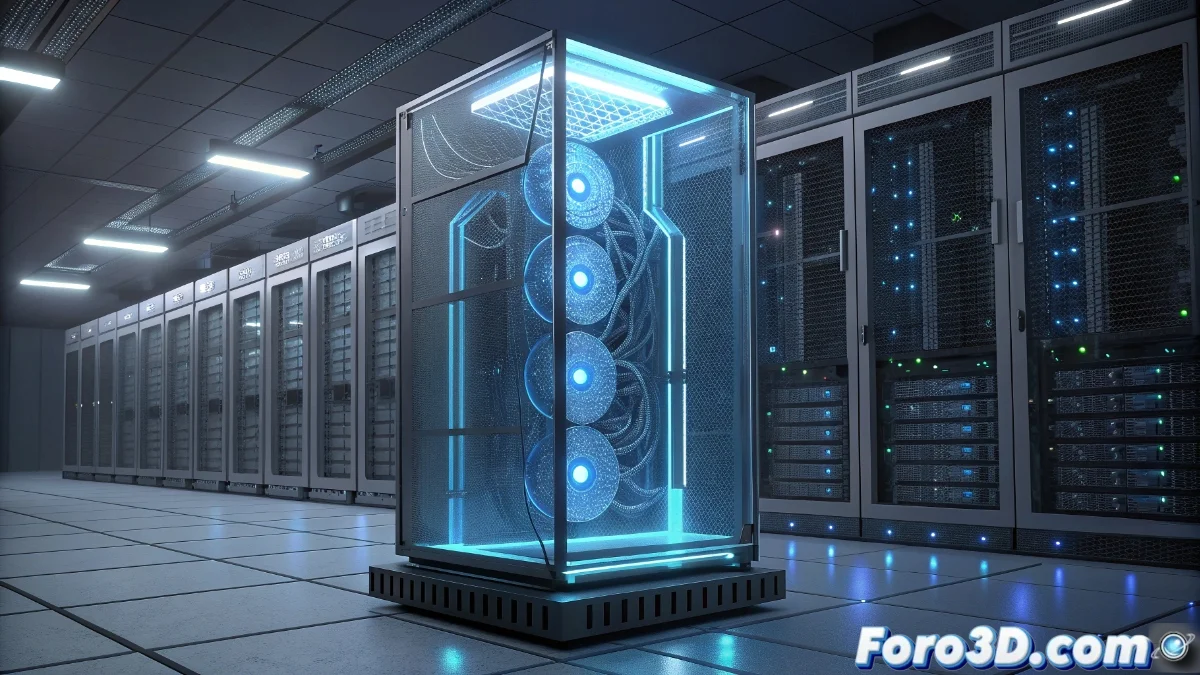

خادم NVIDIA DGX A100: قوة شاملة للذكاء الاصطناعي

يُشكل خادم NVIDIA DGX A100 المخصص حلاً شاملاً مصمماً خصيصاً لـ التدريب الضخم ونشر أنظمة الذكاء الاصطناعي. تدمج هذه المنصة ثماني وحدات معالجة رسوميات A100 متصلة بتقنية NVLink، مما يخلق نظاماً بيئياً للحوسبة المتوازية غير مسبوق. 🚀

هندسة حوسبة متقدمة

تُنشئ الترابط NVLink بين الثماني GPUs A100 مجال ذاكرة موحد يُحدث ثورة في معالجة البيانات. تُزيل هذه التهيئة تماماً عنق الزجاجة التقليدي في نقل المعلومات، مما يسمح بتدريب نماذج التعلم العميق الأكثر تعقيداً في أوقات مختصرة بشكل كبير.

المكونات الرئيسية للنظام:- ثماني GPUs NVIDIA A100 مع ترابط NVLink عالي السرعة

- معالج AMD EPYC عالي الأداء للإدارة المركزية

- 1 تيرابايت من ذاكرة RAM للتعامل مع مجموعات بيانات ضخمة

- تخزين NVMe لنقل فائق السرعة

- نظام تبريد متقدم لأقصى كفاءة طاقية

- تحسين أصلي لـ TensorFlow وPyTorch وإطارات أخرى

يُسهل التصميم الداخلي للمعالجة الموزعة التعامل مع مجموعات بيانات تفوق التيرابايت، مع الحفاظ على كفاءة طاقية مثالية من خلال تقنية تبريد من الجيل الأحدث.

تطبيقات في بيئات مهنية

يُوجه هذا النظام خصيصاً نحو مشاريع بحث متقدمة حيث تكون مقياس النماذج أو حجم البيانات غير قابلة للإدارة ببنى تحتية تقليدية. تستخدم الجامعات والشركات التكنولوجية DGX A100 لتطوير أنظمة اللغة الطبيعية، رؤية حاسوبية للمركبات الذاتية القيادة، ومحاكاة علمية معقدة.

الحالات الاستخدامية الرئيسية:- تطوير نماذج اللغة الطبيعية على نطاق صناعي

- أنظمة رؤية حاسوبية للسيارات الذاتية القيادة

- محاكاة علمية وبحثية متقدمة

- تنفيذ مهام متعددة من خلال الافتراضية

- تقليل زمن الاستجابة في عمليات الاستدلال في الوقت الفعلي

- تحسين معدل الإنتاج في معالجة الدفعات الضخمة

اعتبارات عملية للتنفيذ

تسمح الافتراضية لـ GPUs بتنفيذ مهام متعددة في وقت واحد، مما يحول هذه المنصة إلى حل متعدد الاستخدامات سواء لبيئات التطوير أو الإنتاج. من الضروري مراعاة أنه عندما تعمل جميع GPUs بكامل طاقتها، يتطلب الاستهلاك الطاقي بنية تحتية كهربائية متخصصة، مشابهة لاستهلاك المنشآت الصناعية المتوسطة الحجم. ⚡