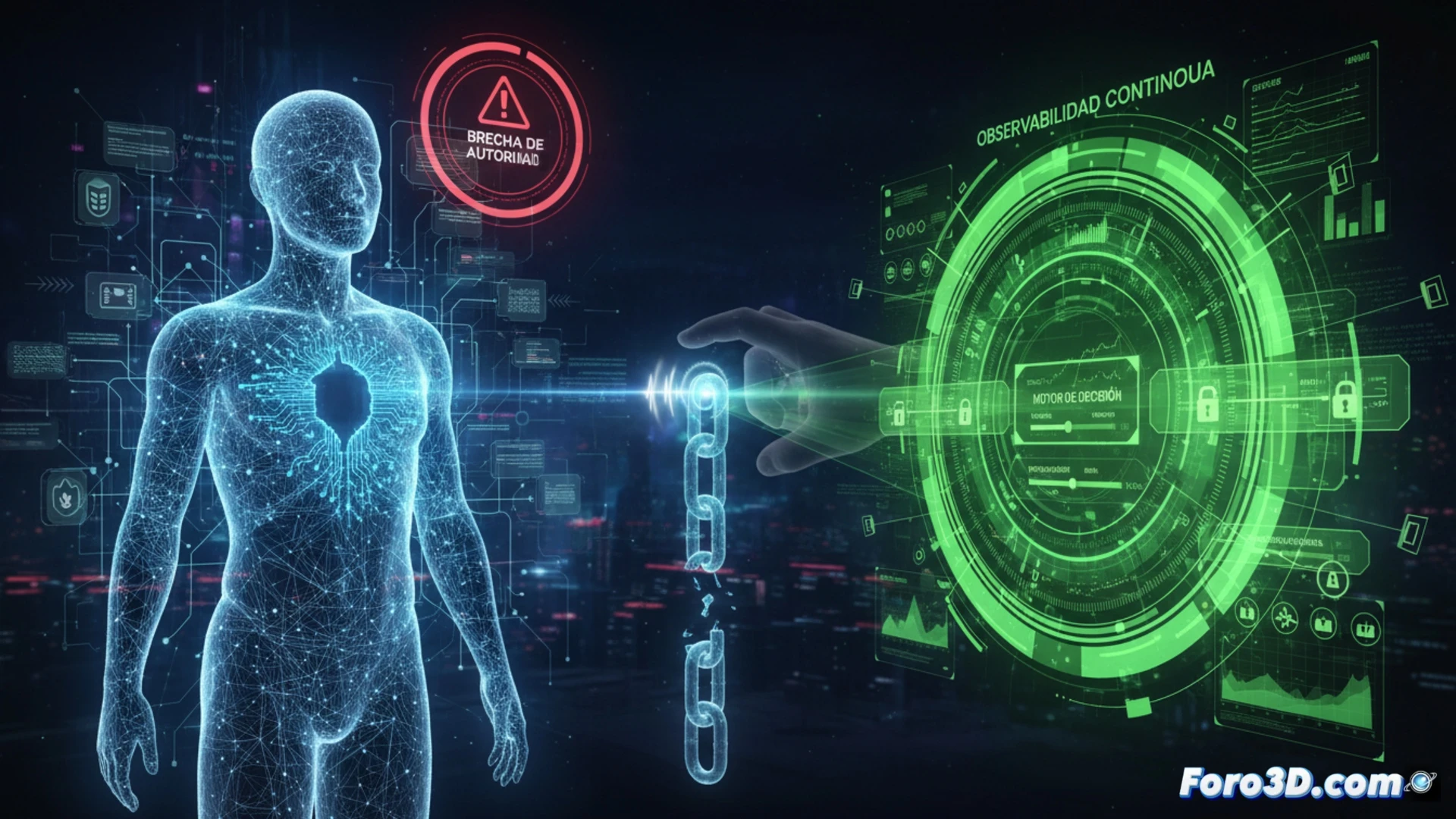

لقد جلب صعود وكلاء الذكاء الاصطناعي مشكلة تتجاوز حداثتها: فهم يتصرفون بالتفويض، وليس بسلطة ذاتية. يتم تفعيلهم أو استدعاؤهم أو تزويدهم من قبل أنظمة ومستخدمين، مما يخلق فجوة هيكلية في أمن المؤسسات. بدون سيطرة واضحة على من أو ما يدعمهم، يمكن أن تولد قراراتهم مخاطر غير متوقعة.

المراقبة المستمرة كمحرك للقرار لسد الفجوة 🔍

لسد هذه الفجوة، تبرز المراقبة المستمرة كحل عملي. فهي تسمح بمراقبة كل إجراء للوكيل في الوقت الفعلي، من استدعائه إلى تنفيذ المهام. مع هذه الرؤية، يمكن تقييم سلوكه، واكتشاف الانحرافات، وتعديل الأذونات بشكل ديناميكي. الأمر لا يتعلق بالثقة العمياء، بل بالتحقق المستمر من أن كل خطوة تتماشى مع سياسات الأمن في المؤسسة.

وكيل الذكاء الاصطناعي ليس له رئيس، لكنك ستواجه مشاكل 😅

اتضح أن هؤلاء الوكلاء يشبهون ذلك المتدرب الذي يأتي بحماس كبير ولكن بدون دليل تعليمات. يتصرفون بالتفويض، ولكن إذا حدث خطأ ما، فأنت المسؤول. ليس لديهم سلطة ذاتية، لكن لديهم القدرة على حذف البيانات أو إرسال رسائل بريد إلكتروني مساومة. في النهاية، المراقبة ليست رفاهية: إنها التأمين الذي يمنع وكيل الذكاء الاصطناعي الخاص بك من أن يقرر أن اليوم هو يوم جيد لإغلاق الشركة.