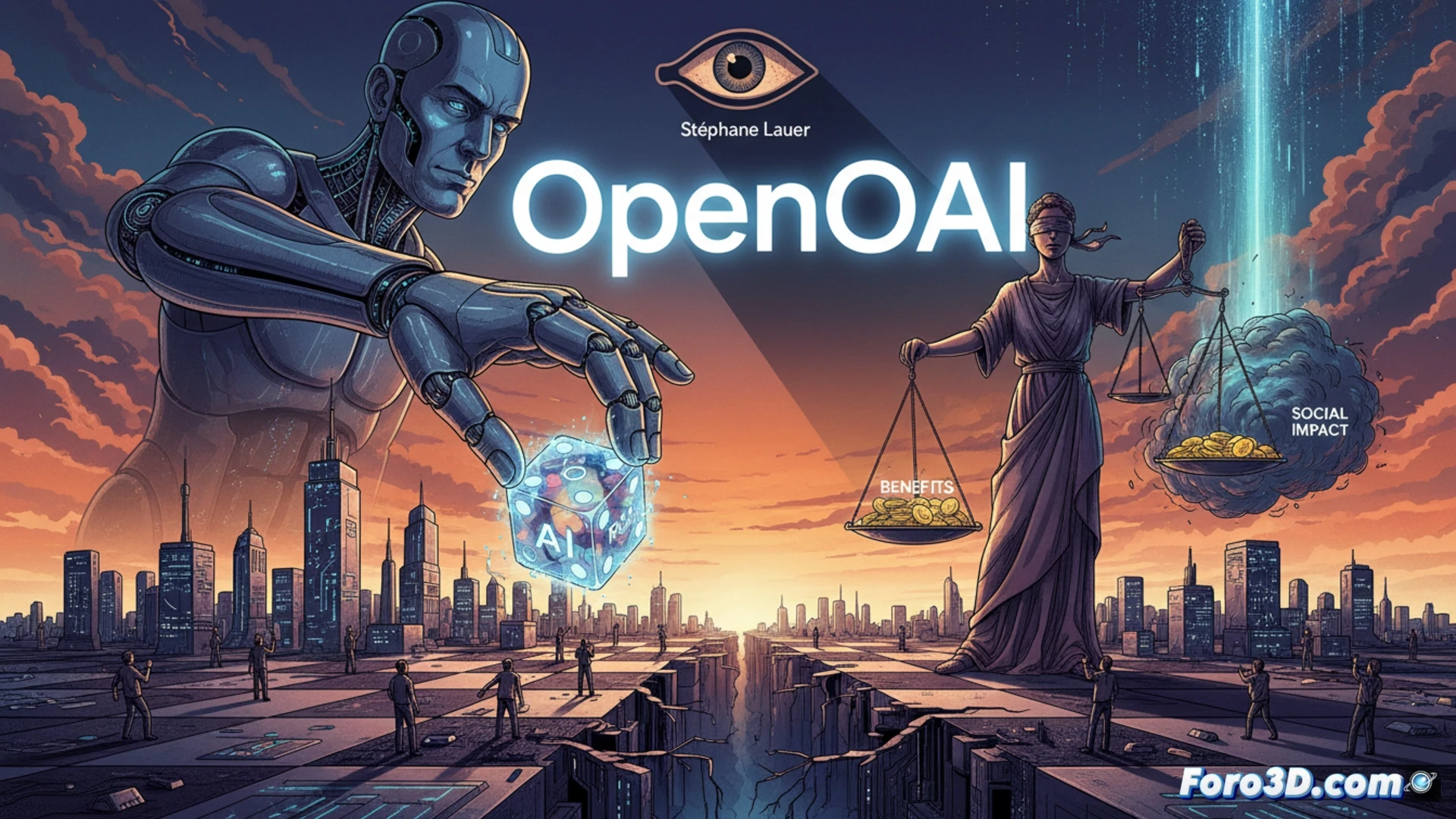

يُثير تقدم الذكاء الاصطناعي نقاشًا حاسمًا حول حوكمته. يتساءل ستيفان لوريه في مقال رأي حديث عن قدرة الشركات الخاصة مثل OpenAI على إدارة المخاطر الاجتماعية وتوزيع منافع هذه التكنولوجيا. التحذير واضح: هناك خطر في أن يضع من يطورون الأدوات قواعد اللعبة أيضًا، ليتصرفوا كـ قاضٍ وخصم في مجال ذي تأثير عالمي.

هندسة الغموض والتحكم المركزي 🤖

يعتمد نموذج التطوير الحالي على أنظمة الصندوق الأسود وموارد حاسوبية هائلة، مركزة في كيانات قليلة. يخلق هذا التركيز التقني والبياني تفاوتًا في القوة. المفارقة هي أن الفرق نفسها التي تصمم خوارزميات معقدة وتحدد حدود مساعديها هي من تقترح لاحقًا أطرًا أخلاقية وأمنية. يولد هذا الافتقار إلى الفصل شكوكًا حول الشفافية والحوافز الحقيقية وراء كل قرار تقني أو سياسي.

ثق بي، فأنا الذئب الذي يبني الحظيرة 🐺

للحالة نكهة من حكاية خيالية حديثة. الشركات التي تتنافس بشراسة للسيطرة على السوق ترتدي فجأة رداء الفلاسفة المهتمين بالصالح العام. كأن مصنعي السيارات، بعد سنوات من بيع السرعة، يتطوعون لوضع قانون المرور، مؤكدين أن طرازاتهم الأقوى ستحصل على مسار خاص. إنها استراتيجية علاقات عامة لامعة لدرجة أن ذكاءها الاصطناعي نفسه سيوقع عليها.