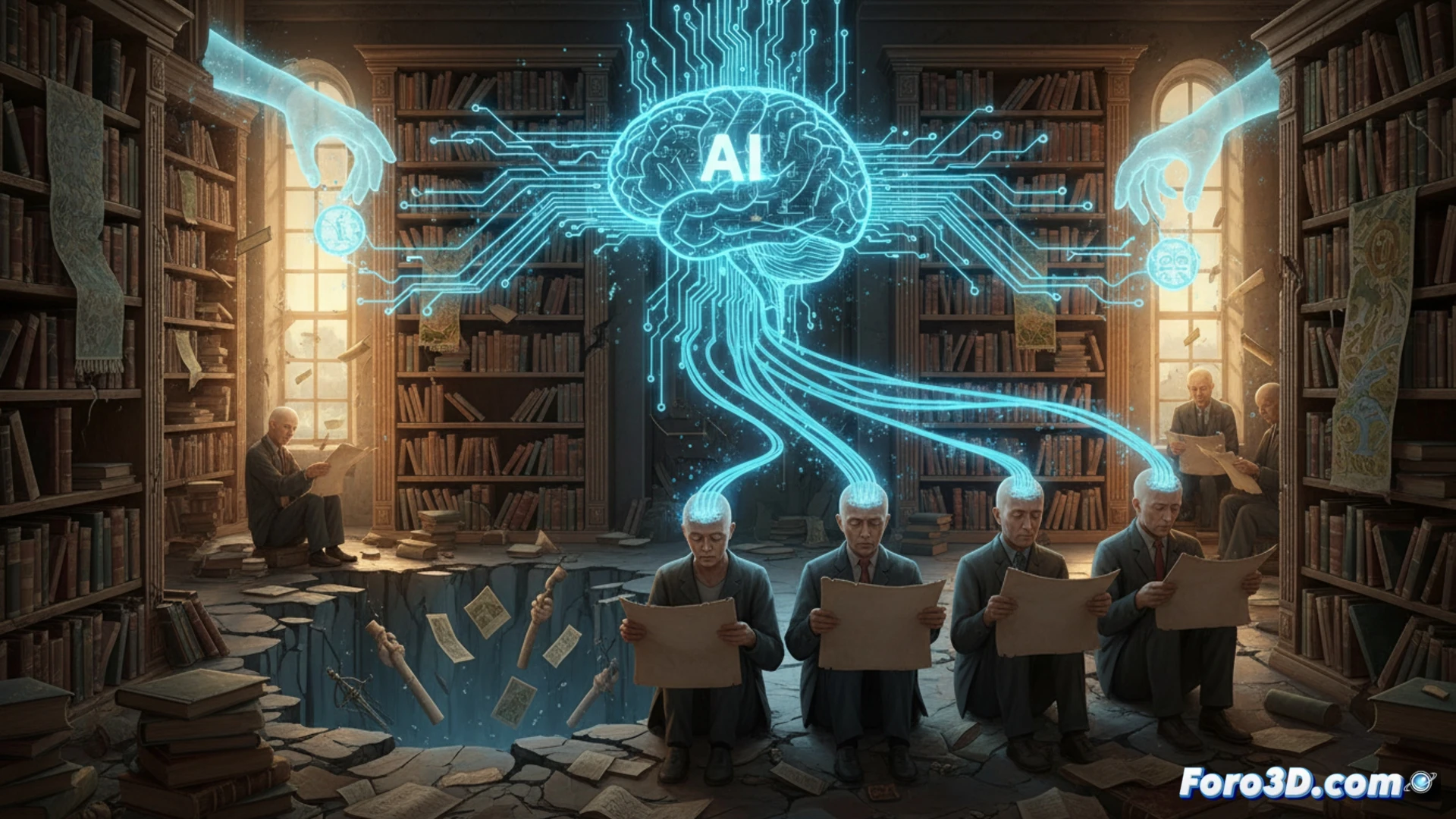

Cada vez más usuarios delegan la búsqueda de información en asistentes de IA. Estos sistemas ofrecen respuestas directas, pero este modelo conlleva un riesgo: la atrofia de nuestras propias capacidades para buscar, filtrar y validar datos. La comodidad tiene un coste en habilidades críticas.

El problema técnico detrás de la caja negra conversacional 🤖

Los modelos de lenguaje no son motores de búsqueda tradicionales. Operan como cajas negras que sintetizan información, a menudo sin revelar sus fuentes primarias ni el proceso de ponderación. Esto elimina la necesidad del usuario de evaluar la relevancia de los resultados, contrastar versiones en diferentes sitios o entender la estructura de la web. La habilidad para construir consultas precisas usando operadores lógicos se pierde.

Bienvenidos a la era del 'copy-paste' intelectual 🧠

Nuestro nuevo flujo de trabajo es impecable: preguntamos, la IA responde con un párrafo compacto, y nosotros lo aceptamos con fe ciega. Ya no necesitamos abrir diez pestañas, comparar foros o dudar de un blog sospechoso. Hemos externalizado el pensamiento crítico. Pronto, la habilidad más valiosa será identificar el tono de voz más persuasivo para pedirle a la máquina que piense por nosotros.