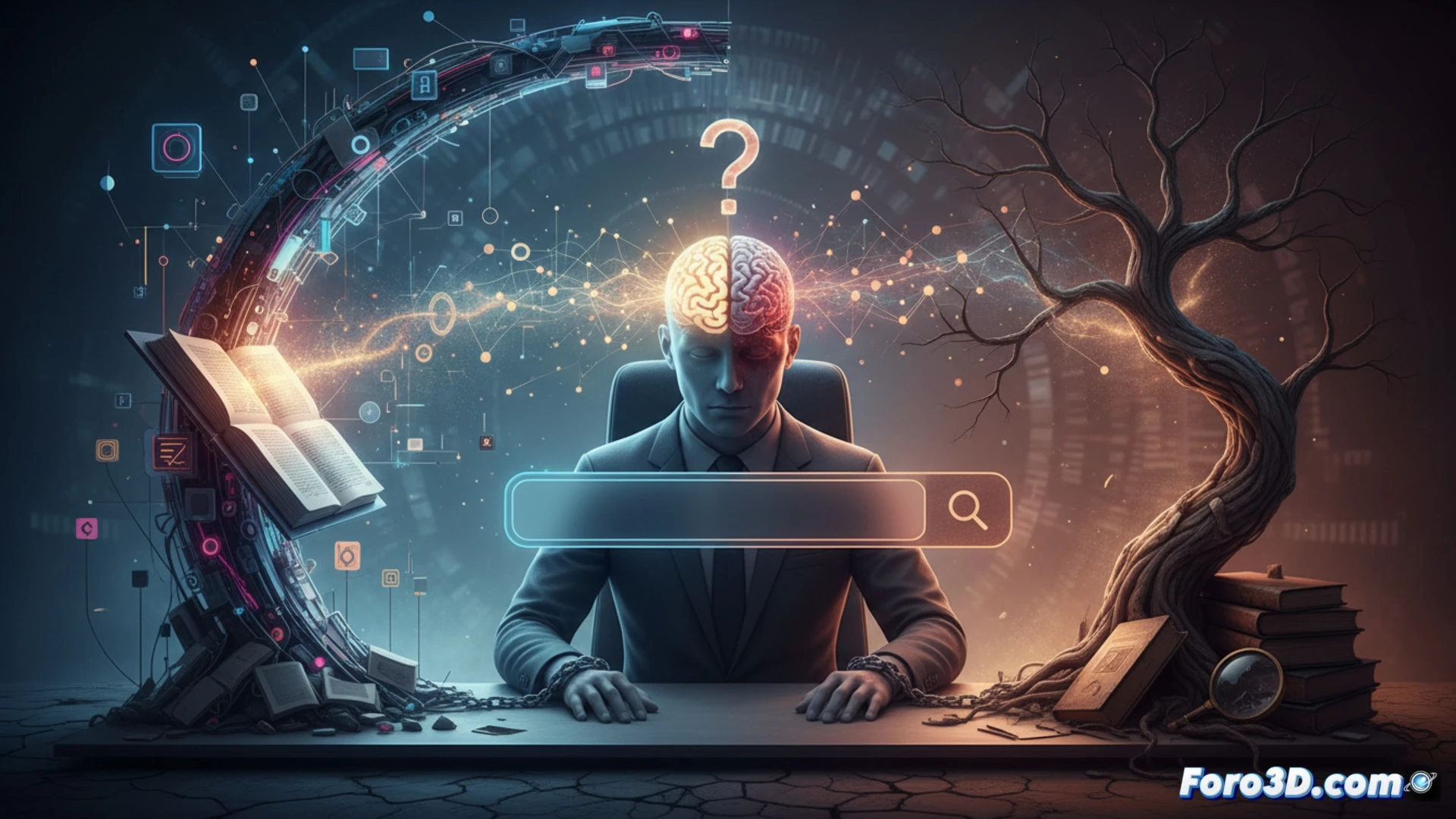

El auge de los asistentes de IA conversacionales está transformando cómo obtenemos información. En lugar de buscar términos y evaluar fuentes, muchos usuarios plantean preguntas directas y aceptan la respuesta generada. Esta dinámica plantea un debate sobre la dependencia informativa y un posible debilitamiento de nuestras habilidades de investigación y pensamiento crítico.

Arquitectura de la dependencia: APIs y falta de trazabilidad 🤖

Técnicamente, estas IA funcionan como cajas negras. El usuario interactúa con una API que consume un modelo de lenguaje entrenado en datos masivos, pero sin acceso a las fuentes primarias. El sistema genera una respuesta coherente, pero no un listado de referencias verificables. Esto elimina el paso crucial de contrastar información, base del aprendizaje y el desarrollo técnico. La comodidad suplanta la verificación.

Entrenando para la obsolescencia, un prompt a la vez 🧠

Es curioso. Pasamos años aprendiendo a formular preguntas clave para Google, y ahora entrenamos para hacer prompts perfectos a una IA. Nuestro mayor logro cognitivo podría ser dominar la ingeniería de prompts para que la máquina piense por nosotros. Pronto, el razonamiento será una feature de suscripción premium. ¿Quién necesita habilidades de investigación cuando puedes tener un confidente digital que siempre tiene razón, incluso cuando se inventa cosas?